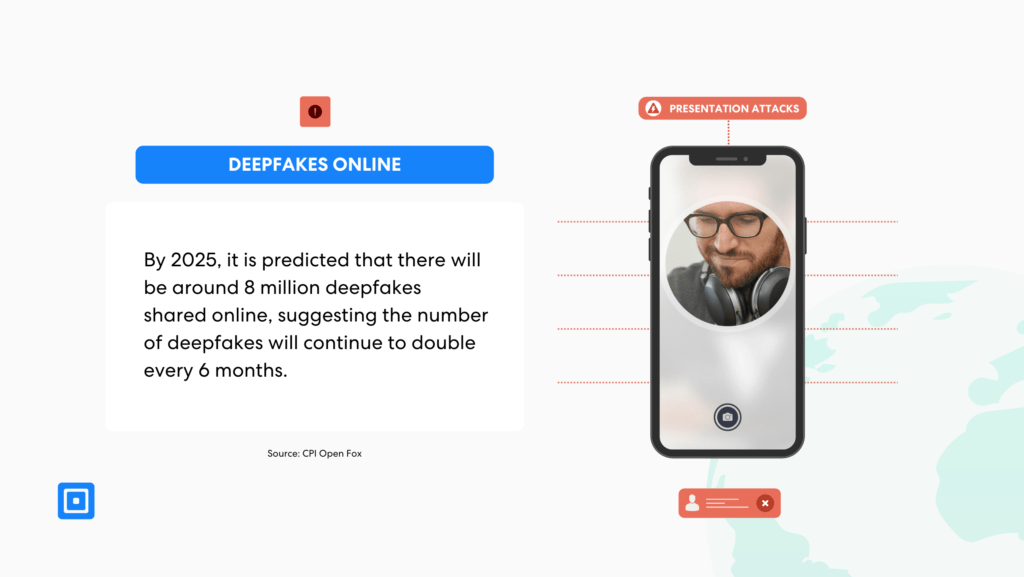

Die KI-Technologie hat sich durch Deepfake-Betrug schnell von einer Neuheit zu einer Bedrohung für sozioökonomische, politische und demokratische Prozesse weltweit entwickelt. Deepfake-Erkennungssoftware, einschließlich Lösungen zur Identitätsüberprüfung (IDV) wie Dokumentenüberprüfung und biometrische Überprüfung, muss schnell eingeführt werden, um sicherzustellen, dass Volkswirtschaften, Regierungen und unser Alltagsleben ohne Unterbrechung weiterlaufen können.

Die Auswirkungen von Deepfakes auf Wahlen, öffentliches Vertrauen und die Authentizität von Unternehmen sind ein wachsendes Problem. Angesichts kritischer Wahlzyklen in mehreren Demokratien ist es wichtiger denn je, die Gefahren zu verstehen, die diese Technologie mit sich bringt. In diesem Leitfaden wird genauer untersucht, wie diese Bedrohungen entstehen und welche Best Practices es gibt, um zu verhindern, dass sie die digitale Welt plagen.

Was ist ein Deepfake?

Deepfakes haben ihren Namen von einer Methode der künstlichen Intelligenz (KI), dem Deep Learning. Ein Deep-Learning-Algorithmus ist in der Lage, sich selbst beizubringen, wie man extrem komplexe Probleme löst, indem er riesige Datensätze analysiert. Diese Algorithmen können Gesichter in Bilder, Videos, Töne und jede andere Form von digitalem Inhalt einfügen, um hyperrealistische, aber gefälschte Inhalte zu erstellen.

Die Welt steuert rasch auf eine Deepfake-Krise zu. Große Befürchtungen bestehen darüber, welche Auswirkungen diese KI-Technologie auf das globale sozioökonomische und politische Umfeld haben wird und welche Auswirkungen sie bereits hat. In jüngster Zeit sind auch Befürchtungen hinsichtlich der Integrität der Wahlergebnisse ins Blickfeld der Kritik geraten.

Was ist Deepfake-Erkennung?

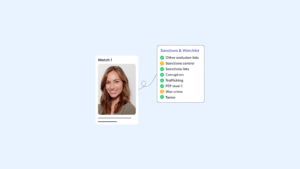

Bei der Deepfake-Erkennung handelt es sich um einen Prozess, der Bilder, Töne oder Videos identifiziert, die künstlich erstellt wurden, um hyperrealistisch auszusehen. Im Allgemeinen wird generative KI bei der Dokumentenüberprüfung und biometrischen Überprüfung eingesetzt, um Muster in Deepfake-Inhalten zu erkennen, die in „echten Inhalten“ nicht vorhanden wären.

KI-gestützte IDV-Lösungen werden schnell zur einzigen Möglichkeit, Deepfake-Technologien zuverlässig entgegenzuwirken und diese Art von Identitätsbetrug einzudämmen. Im Vergleich zu einem Menschen können diese Technologien gefälschte Inhalte weitaus effektiver identifizieren und in einem bestimmten Zeitraum weitaus mehr Daten verarbeiten, weitaus genauer und weitaus kostengünstiger.

Im September 2023 veröffentlichten drei wichtige Strafverfolgungsbehörden – die National Security Agency (NSA), das Federal Bureau of Investigation (FBI) und die Cybersecurity and Infrastructure Security Agency (CISA) – ein Papier, in dem sie erklärten, dass die Bedrohung durch Deepfakes exponentiell zugenommen habe und automatisierte und präventive Technologien unerlässlich seien.

Bedrohungen durch synthetische Medien wie Deepfakes, haben exponentiell zugenommen.

Die steigende Bedrohung durch Deepfakes weltweit und branchenübergreifend erfordert einen größeren Bedarf an robusten Lösungen zur Identitätsüberprüfung. Solche Lösungen erfordern eine ähnliche generative künstliche Intelligenz (Gen AI), um vorbeugende Maßnahmen zu ermöglichen, die betrügerischen Bedrohungen entgegenwirken können.

Dokumentenprüfung

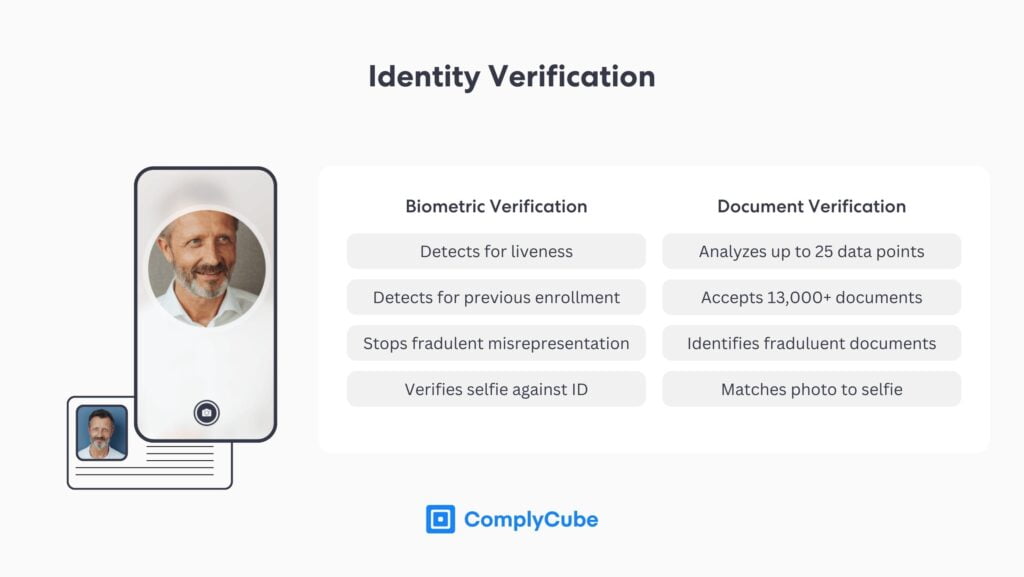

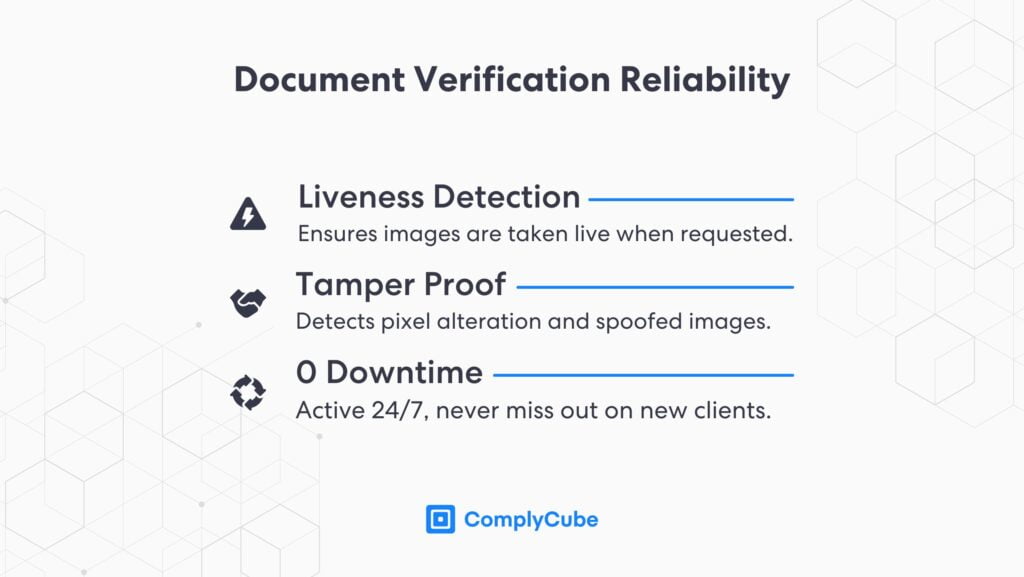

Dokumentenprüfung ist einer der beiden wichtigsten Schritte in den Prozessen zur Geldwäschebekämpfung (AML), Know Your Customer (KYC) und IDV. Dieser Prozess verwendet eine KI-gestützte Verifizierungs-Engine, um KYC-Dokumente wie einen Führerschein in weniger als 15 Sekunden zu lesen.

Durch die gleichzeitige Überprüfung der Dokumentenauthentizität und die Extraktion der verfügbaren Daten bietet die Dokumentenüberprüfung ein hohes Maß an Identitätssicherheit. Sie fungiert auch als robustes vorläufiges Deepfake-Erkennungssystem und kann künstlich erstellte Bilder von Ausweisen identifizieren. Weitere Informationen zu Gen AI und Deepfake-Erkennungsmethoden finden Sie unter Generative KI: Betrugs- und Identitätsüberprüfung.

Biometrische Verifizierung

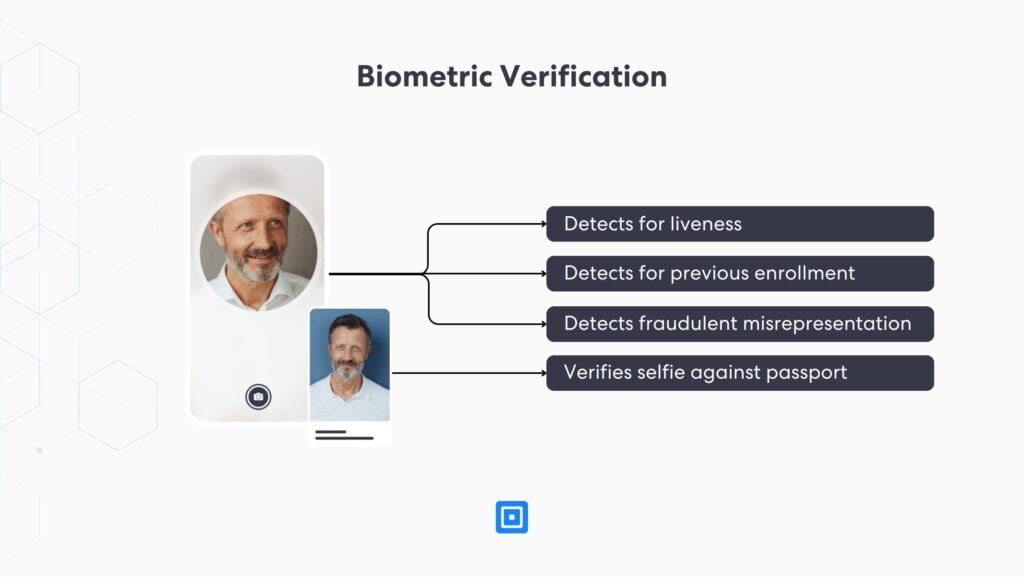

Biometrische Verifizierung verwendet leistungsstarke Technologien zur biometrischen Identifizierung und Gesichtserkennung, um biometrische Daten von Benutzern zu scannen, zu verifizieren und zu authentifizieren. Durch die Analyse biometrischer Informationen wie Gesichtszüge, Mikroausdrücke, Hauttöne und Texturen (manchmal unter Verwendung alternativer Daten wie Iris-Scans) fungiert dieser Prozess als Tool zur Echtheitserkennung und verhindert Präsentationsangriffe wie Deepfakes.

Biometrische Authentifizierung und Verifizierung sind die sichersten Methoden zur Überprüfung der Identität einer Person und für die Erkennung von Deepfakes unerlässlich. Biometrische Daten sind selbst mit KI am schwierigsten zu fälschen. Dies bedeutet jedoch nicht, dass Deepfakes leicht zu erkennen sind.

Automatisierte IDV-Lösungen sind eine wichtige Komponente moderner Identitätsprüfungs-, Kundenakquise- und Authentifizierungsprozesse, da eine große Menge an Prüfungen präzise und in großem Umfang durchgeführt werden muss. Weitere Informationen finden Sie unter Die Vorteile der biometrischen Verifizierung.

Deepfakes und Wahlintegrität

Deepfakes haben das Potenzial, Wahlen zu untergraben, indem sie falsche Informationen verbreiten und die öffentliche Meinung manipulieren. In Großbritannien ergab eine aktuelle Studie des Alan Turing Institute, dass fast neun von zehn Menschen besorgt sind, dass Deepfakes das Wahlergebnis beeinflussen könnten (The Alan Turing Institute).

9 von 10 sind besorgt über Deepfakes Einfluss auf die Wahlergebnisse.

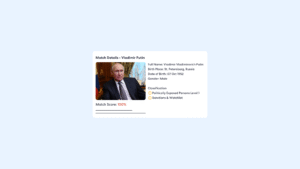

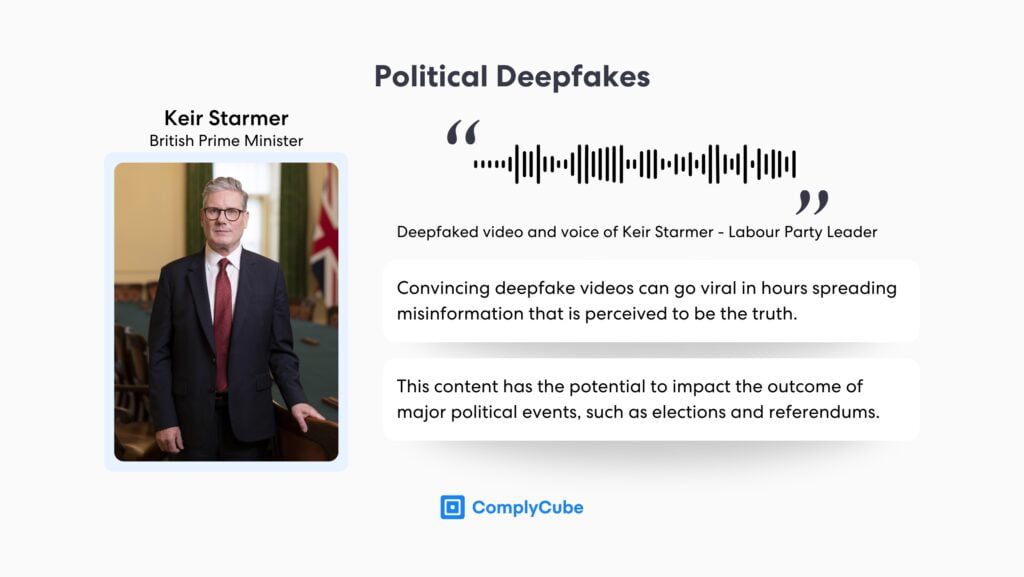

Diese Sorge ist nicht unbegründet. Es sind bereits spektakuläre Fälle aufgetaucht, in denen Deepfakes auf Politiker abzielten, etwa gefälschte Audio- und Videoclips prominenter Politiker, die das Potenzial haben, Zwietracht und Verwirrung unter den Wählern zu säen.

So wurden beispielsweise im Vorfeld der britischen Parlamentswahlen im Jahr 2024 Deepfakes, die die Stimmen des damaligen Premierministers Rishi Sunak, des Labour-Vorsitzenden Keir Starmer und des Londoner Bürgermeisters Sadiq Khan imitierten, in den sozialen Medien verbreitet. Sie erreichten Hunderttausende Zuschauer und stifteten Missverständnisse.

Diese Manipulationen reichten von erfundenen Korruptionsskandalen bis hin zu irreführenden Aussagen über politische Positionen und Absichten. Solche Inhalte können unglaublich schädlich sein, insbesondere wenn die Wähler nicht zwischen echten und gefälschten Inhalten unterscheiden können.

Deepfake-Erkennung und Reaktion

Das Erkennen von Deepfakes wird immer schwieriger, selbst für Technologiegiganten wie Meta, Google und Microsoft, die sich verpflichtet haben, gegen betrügerische KI bei Wahlen vorzugehen. Das Hauptproblem liegt in der Komplexität der KI-Tools, die Inhalte erstellen können, die von der Realität nicht zu unterscheiden sind.

So hat beispielsweise Nick Clegg, Präsident von Meta für globale Angelegenheiten, die Herausforderungen bei der Identifizierung von KI-generierten Inhalten festgestellt. Betonung der Tatsache, dass böswillige Akteure unsichtbare Markierungen entfernen können, die normalerweise auf Manipulation hinweisen.

Die Bedrohung durch Deepfakes ist global und scheint internationale Ereignisse zu verfolgen. In Amerika imitieren Deepfakes Die Stimme von Präsident Joe Biden wurde in einem Robocall verwendet, um falsche Informationen über die Wahl zu verbreiten. Dieser Vorfall unterstreicht das Potenzial von Deepfakes, durch die Verbreitung irreführender Informationen die Wahlbeteiligung zu senken.

Darüber hinaus geht das Problem über die bloße Identifizierung von Deepfakes hinaus. Die schnelle Verbreitung betrügerischer Inhalte bedeutet, dass, sobald ein Deepfake viral geht, der Schaden wahrscheinlich bereits angerichtet ist, bevor das Bild oder Video entlarvt wird.

Dies erfordert Maßnahmen gegen betrügerische Inhalte, bevor diese hochgeladen werden können. Social-Media-Plattformen wie Twitter (jetzt X), Facebook, Instagram und viele andere müssen robuste KI-gestützte Abwehrmaßnahmen einsetzen, um betrügerische Medien zu erkennen, bevor sie gepostet werden können. Eine solche Maßnahme könnte über leistungsstarke SDKs und APIs zur Echtzeiterkennung durchgeführt werden. Weitere Informationen finden Sie unter Integration mit einem Liveness Detection SDK.

Deepfake-Erkennung bei der Identitätsüberprüfung

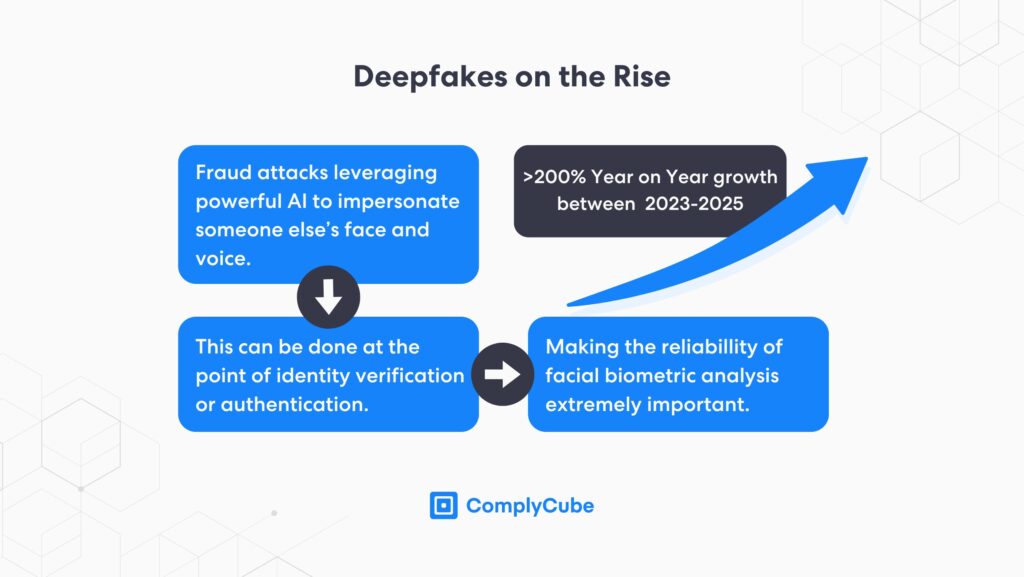

Deepfakes haben weit mehr Branchen als nur soziale Medien infiltriert. Sie sind zu einem Hauptproblem bei Identitätsüberprüfungs- und Authentifizierungsmethoden für mehrere Finanzbranchen geworden, darunter traditionelle Bankanwendungen, Handels- und Krypto-Apps und Zahlungsdienste. Deepfake-Angriffe werden täglich eingesetzt, um Betrug zu begehen, Konten zu plündern und sogar neue Konten zu eröffnen, beispielsweise bei Kreditunternehmen.

Generative KI stellt die größte Bedrohung für die [Finanz-]Industrie dar, Dadurch könnten die Betrugsverluste in den USA bis 2027 auf $40bn ansteigen, gegenüber $12,3 Mrd. im Jahr 2023.

Diese Vorhersage lässt darauf schließen, dass der Deepfake-Betrug innerhalb von vier Jahren um über 200% eskalieren und zu einem der Hauptverursacher des weltweiten Finanzbetrugs werden könnte.

Vertrauensverlust durch betrügerische Technologie

Über Wahlen hinaus stellt die Verbreitung von Deepfakes eine umfassendere Bedrohung für das öffentliche und private Vertrauen in Informationen und Identität dar. Mit der zunehmenden Verbreitung der Deepfake-Technologie werden die Menschen gegenüber den Medien, die sie konsumieren, zunehmend skeptischer. Diese Skepsis gegenüber den Medien könnte zu einem Phänomen führen, das als Lügnerdividende, wo die Möglichkeit gefälschter Inhalte den Einzelnen eine glaubhafte Abstreitbarkeit bietet und so Verantwortlichkeit und Wahrheit untergräbt.

Ein häufiges Beispiel für dieses Phänomen ist die schädliche Berichterstattung über eine Persönlichkeit des öffentlichen Lebens, einen Politiker oder einen Wirtschaftsführer in den Medien. Skepsis gegenüber authentischen Medien ermöglicht es diesen Personen, diese öffentliche Meinung zu nutzen und zu behaupten, sie sei nicht echt. Es ist leicht zu erkennen, wie dieser Effekt anwachsen kann.

Vertrauen im großen Maßstab aufbauen mit Software zur Deepfake-Erkennung

Obwohl die Gefahren von Deepfakes offensichtlich sind, werden wirksame regulatorische Maßnahmen noch entwickelt. In den USA fehlen zwar landesweite Regulierungsmaßnahmen, aber mindestens 20 Bundesstaaten haben Gesetze gegen Wahl-Deepfakes erlassen, aber eine schlüssige Strategie auf Bundesebene ist noch nicht in Sicht. Das Finanzministerium hat sich jedoch verpflichtet, automatisierte Technologien zu unterstützen als beste Maßnahme zur Vorbeugung und Bekämpfung neu auftretender betrügerischer Methoden.

Auch in Großbritannien sind die Fortschritte begrenzt. Zwar gibt es Gesetze gegen die Erstellung und Verbreitung von schädlichen Deepfake-Inhalten, wie etwa expliziten Deepfakes, doch umfassendere Regelungen gegen die Erstellung und Verwendung von Deepfakes zur Wahlmanipulation müssen noch erlassen werden.

Vorerst bleibt es dem betreffenden Unternehmen überlassen, robuste IDV-Lösungen zu implementieren, um der betrügerischen Deepfake-Bewegung entgegenzuwirken. Unternehmen müssen die Möglichkeit von Deepfake-Betrug in ihren risikobasierten Ansatz (RBA) einbeziehen, wenn sie eine geeignete AML-Strategie in Betracht ziehen.

Über ComplyCube

Um der wachsenden Bedrohung durch KI-Betrug entgegenzuwirken, sind Deepfake-Erkennungstechnologien und IDV-Lösungen heute unverzichtbar. Diese Technologien nutzen Gen AI, um ähnliche Datensätze zu scannen, die zur Erstellung von Deepfakes verwendet werden, um gefälschte Inhalte zu identifizieren und Betrug einzudämmen.

Die Dokumentenüberprüfung und die biometrische Verifizierung von ComplyCube sind zwei wichtige Methoden, die bei IDV zur Überprüfung und Authentifizierung von Identitäten durch Erkennung von Deepfake-Inhalten verwendet werden und von Hunderten von Technologieunternehmen auf der ganzen Welt eingesetzt werden.

Der führende Anbieter von IDV-Lösungen wurde gegründet, um die wachsenden Bedrohungen durch innovative Betrugsmethoden im 21. Jahrhundert zu bekämpfen. Durch den Einsatz fortschrittlicher KI- und maschineller Lernalgorithmen bietet die Plattform von ComplyCube umfassende IDV- und biometrische Verifizierungsdienste und gewährleistet so einen robusten Schutz vor Identitätsbetrug und Deepfake-Inhalten.

Mit einer flexiblen und anpassbaren Lösung können ihre Dienste entsprechend der RBA eines Unternehmens angepasst werden, um Unternehmen dabei zu helfen, ihre Sicherheitsprotokolle zu verbessern, die Einhaltung gesetzlicher Standards aufrechtzuerhalten und das Vertrauen ihrer Kunden in einer zunehmend digitalen Welt aufzubauen. Weitere Informationen finden Sie unter Kontaktieren Sie noch heute einen Compliance-Spezialisten.