Die globale Politik hängt von sich verändernden Narrativen ab, die täglich von Millionen Menschen neu geschrieben werden, während unsere Meinungen von dem, was wir zuletzt auf Twitter lesen, geprägt werden. Wenn das, was wir lesen, die Ansichten echter Menschen aus allen Gesellschaftsschichten sind, profitieren wir sicherlich von der Meinungsfreiheit, einem eindeutig demokratischen Einsatz von Technologie. Wenn das, was wir lesen, jedoch die Folge fehlender notwendiger Identitätsprüfungen und betrügerischer Bots in den sozialen Medien ist, ist es alles andere als demokratisch – es ist ein Versuch, einen Raum zu kontrollieren, der uns gehören sollte. Das Fehlen von Überprüfungspraktiken in den sozialen Medien auf Online-Plattformen hat es böswilligen Akteuren ermöglicht, globale Diskussionen zu steuern und häufig falsche Informationen zu verbreiten, um eine bestimmte politische Agenda durchzusetzen. Die Implementierung von Maßnahmen zur Erkennung gefälschter Social-Media-Konten ist daher von entscheidender Bedeutung geworden.

Gefälschte Konten und Bots sind seit langem eng mit der internationalen Politik verbunden und haben im letzten Jahrzehnt weltweit Kontroversen ausgelöst. Hunderte, wenn nicht Tausende von Nachrichtenartikeln berichteten über eine erhöhte Bot-Aktivität auf sozialen Plattformen im Vorfeld von Wahlen. Vor den britischen Wahlen 2024 wurden Artikel wie der Artikel von Global Witness „Untersuchung zeigt, dass Inhalte, die von botähnlichen Konten auf X gepostet wurden, gesehen“ veröffentlicht. 150 Millionen Mal vor den Wahlen im Vereinigten Königreich“ machte deutlich, dass nicht allein die Meinung der breiten Öffentlichkeit der entscheidende Faktor sei.

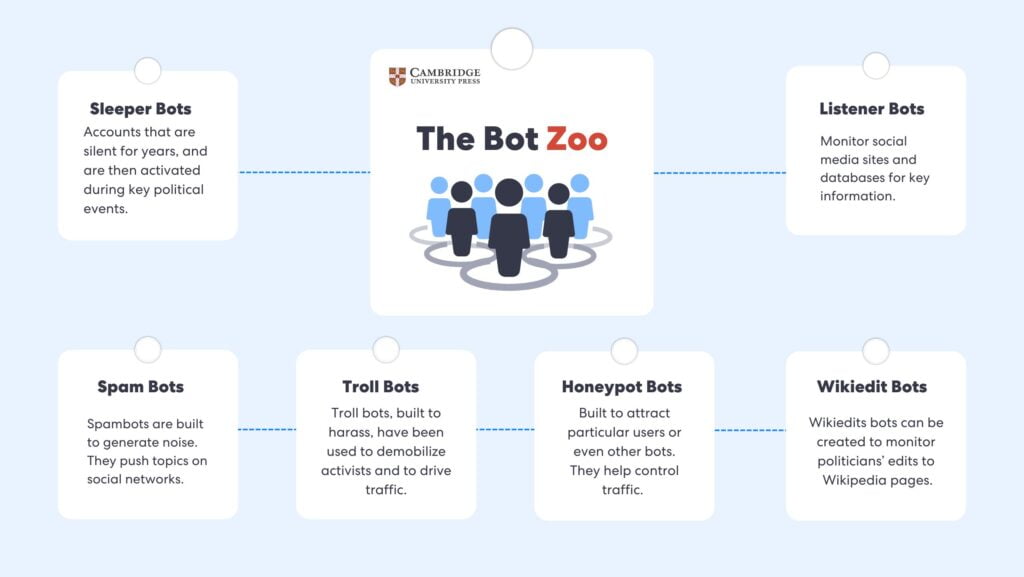

Interessanterweise haben sich nicht nur Medienplattformen zu dem von Bots gesteuerten politischen Datenverkehr geäußert, sondern auch Wissenschaftler haben sich in den letzten 20 Jahren dieser Angelegenheit angenommen. In den frühen Diskussionen über bösartige Bot-Software schrieb T. Holz 2005 einen kritischen Artikel mit dem Titel „Ein kurzer Besuch im Bot-Zoo“. Dies war einer der ersten Artikel, der sich mit Bot-Angriffen im Internet befasste, die damals hauptsächlich für massenhaften Identitätsdiebstahl, Distributed-Denial-of-Service-Angriffe (DDoS) oder den Versand von Spam verwendet wurden.

Holz gelang es, die wichtigsten Merkmale dieser Bots zu erfassen und ihre Eigenschaften und Verhaltensweisen zu skizzieren. Außerdem schuf er eine Struktur, mit der sich verschiedene Arten von Bots kategorisieren ließen. Wissenschaftler aus Cambridge nahmen Holz‘ Arbeit im Jahr 2020 sowie viele andere führende Arbeiten und Studien zum Bot-Verhalten seit 2005 auf und erstellten auf ähnliche Weise ihre eigene Klassifizierung, wobei sie sich speziell auf die Online-Aktivitäten politischer Bots konzentrierten.

Ein Zoo politischer Bots

Wissenschaftler des Cambridge University Press haben ausführlich über den Einsatz und die Gefahren politischer Bots geschrieben. Samuel C. Woolley konnte in seinem 2020 erschienenen Aufsatz „Bots and Computational Propaganda“ echte Fortschritte erzielen: Automatisierung für Kommunikation und Steuerung.” In diesem Artikel führt er aus: „Die Präsenz von Social Bots in politischen Onlinediskussionen kann drei konkrete Probleme mit sich bringen: Erstens kann der Einfluss auf verdächtige Konten umverteilt werden, die möglicherweise zu böswilligen Zwecken betrieben werden. Zweitens kann die politische Konversation weiter polarisiert werden. Drittens kann die Verbreitung von Fehlinformationen und unbestätigten Informationen gefördert werden.“

Er wiederholt Holz' ursprüngliche Bot-Zoo-Klassifikation, wendet das Konzept jedoch an auf politische Bots, wobei die folgenden Kategorien identifiziert werden:

- Listener-Bots: Kann Social-Media-Sites und Datenbanken auf wichtige Informationen überwachen, aber auch seine Erkenntnisse verfolgen und kommunizieren.

- Spambots: Spambots hingegen sind darauf ausgelegt, Lärm zu erzeugen.

- Wikiedit-Bots: Es können Wikiedit-Bots erstellt werden, um die Änderungen von Politikern an Wikipedia-Seiten zu überwachen.

- Sleeper-Bots: Sleeper-Bots sind Social-Media-Konten, die auf Websites wie Twitter jahrelang praktisch ungenutzt herumliegen, um eine realistischere Online-Präsenz zu erzeugen. Sie werden dann bei wichtigen politischen Ereignissen aktiviert.

- Troll-Bots: Troll-Bots wurden zu Belästigungszwecken entwickelt und wurden bereits eingesetzt, um Aktivisten zu trollen, die sich auf Twitter organisieren und kommunizieren wollten. Sie können aber auch den Datenverkehr von einem Anliegen, Produkt oder einer Idee zu einem anderen lenken.

- Honeypot-Bots: Entwickelt, um bestimmte Benutzer oder sogar andere Bots anzuziehen.

Moderne Politik

Die moderne Politik ist zunehmend mit Social-Media-Plattformen verflochten, wo der Kampf um die öffentliche Meinung oft von böswilligen Akteuren und nicht von echtem Diskurs beeinflusst wird. Die Verbreitung von Bots und Fake-Accounts hat die Landschaft des politischen Engagements verändert und ermöglicht es, dass sich Fehlinformationen mit beispielloser Geschwindigkeit verbreiten.

Der Vorfall mit dem chinesischen Spionageballon (2024)

Ein Beispiel hierfür ist ein Fall, der sich Anfang 2024 ereignete, bei dem Armeen von Bots in den sozialen Medien über den Vorfall mit dem chinesischen Spionageballon kämpften. Forscher der Carnegie Mellon University untersuchten 1,2 Millionen Tweets im Zusammenhang mit dem Vorfall und kam zu einigen interessanten Ergebnissen.

Die chinesischen Tweets waren größtenteils künstlich, 641 Prozent der Tweets wurden von Bots geschrieben. Die USA nutzten jedoch ebenfalls Bots, um die Schuld abzuschieben: 351 Prozent ihrer Tweets stammten von Bots. Dieser Fall zeigt, dass viele der Inhalte, denen wir täglich auf Plattformen wie Twitter oder Facebook begegnen, möglicherweise nicht vertrauenswürdig sind, da es immer schwieriger wird, zwischen echten und erfundenen Informationen zu unterscheiden.

Brexit-Referendum (2016)

Dr. Marco Bastos deckte ein Netzwerk von Social-Media-Bots auf, die während der Brexit-Referendumskampagne 2016 dazu verwendet wurden, Twitter mit Wahlbotschaften zu überfluten. Die Untersuchung ergab, dass in den zwei Wochen vor und nach dem Referendum 13.493 Accounts twitterten.

Diese falschen Online-Identitäten äußerten Meinungen und versuchten, Manipulation der öffentlichen Meinung durch schnelle Tweet-Kaskaden.

Wenig überraschend verschwanden diese Profile nach der Abstimmung. In der Untersuchung der City University zu diesem Fall heißt es: „Diese falschen Online-Identitäten äußerten Meinungen und versuchten, die öffentliche Meinung durch eine schnelle Tweet-Kaskade zu manipulieren.“

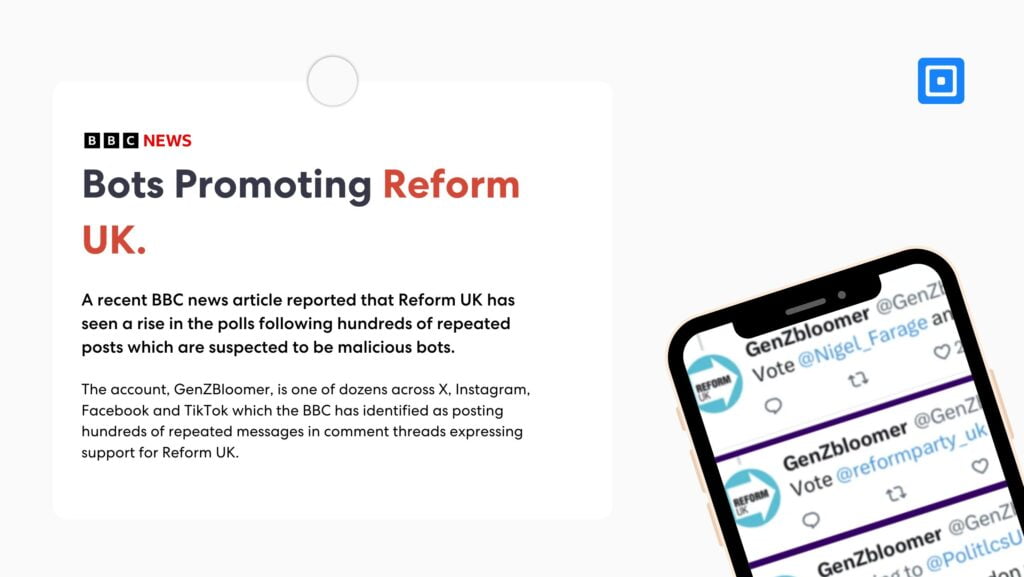

Bots fördern Reformen in Großbritannien (2024)

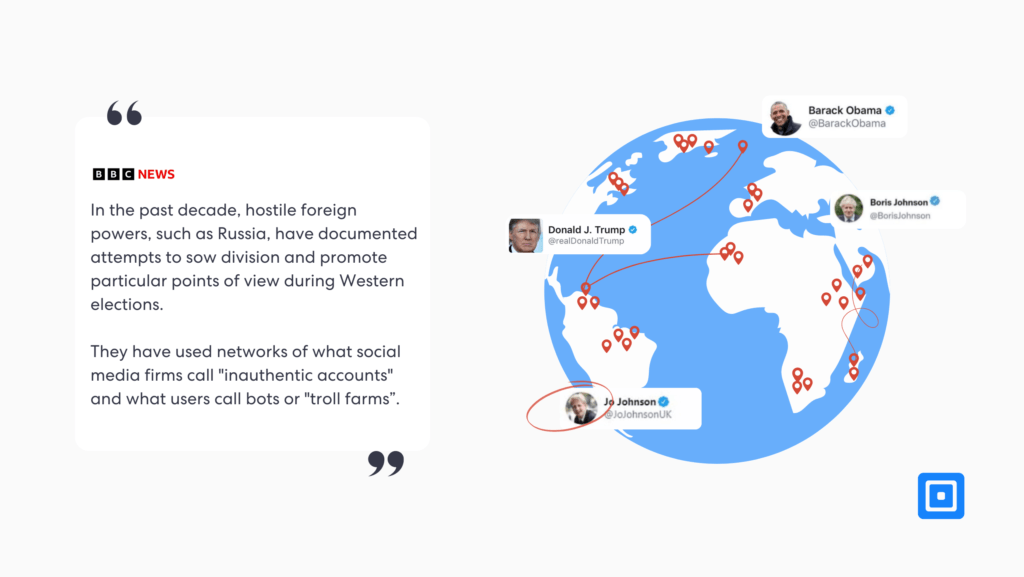

Eine kürzlich BBC-Nachrichtenartikel berichtete, dass Reform UK in den Umfragen nach wiederholten Posts, die vermutlich von bösartigen Bots erstellt wurden, einen Anstieg verzeichnete. Die BBC beschloss, dies genauer zu untersuchen und nahm Kontakt mit den Personen hinter den Konten auf, die offensichtlich versuchten, die Popularität von Reform UK zu übertreiben. Aufgrund von Bedenken hinsichtlich ausländischer Einmischung in andere Wahlen kam die Untersuchung zu dem Schluss, dass viele dieser Konten nicht authentisch waren.

In dem BBC-Artikel heißt es: „Im letzten Jahrzehnt haben feindliche ausländische Mächte wie Russland Versuche dokumentiert, bei westlichen Wahlen Zwietracht zu säen und bestimmte Standpunkte zu fördern. Sie haben Netzwerke von sogenannten ‚nicht authentischen Accounts‘ genutzt, und von Nutzern als Bots oder ‚Troll-Farmen‘ bezeichnet.“

Forscher haben den Einsatz politischer Bots katalogisiert, um die Social-Media-Kennzahlen von Politikern und politischen Kandidaten massiv zu verbessern. Donald Trump an Rodrigo Duterte.

Es ist schwierig, das Ausmaß des Einflusses zu bestimmen, der durch diese Formen der Manipulation erreicht wird, doch viele Journalisten und Akademiker sind zu dem Schluss gekommen, dass sie durchaus sinnvoll sind. Wissenschaftler der Cambridge University Press berichten, dass „Forscher den Einsatz politischer Bots katalogisiert haben, um die Social-Media-Kennzahlen von Politikern und politischen Kandidaten massiv zu verbessern. Donald Trump an Rodrigo Duterte.“

Die Situation unter Kontrolle bringen

Man muss sich fragen, ob Online-Plattformen genug unternehmen, um die Verbreitung bösartiger, von Bots gesteuerter Inhalte einzudämmen. Insbesondere in Wahlperioden scheint es zu einem Anstieg solcher Aktivitäten zu kommen, was auf einen Mangel an robusten Systemen zur Identitätsüberprüfung hindeutet.

Viele Social-Media-Plattformen scheinen zu versuchen, das Problem zu lösen, indem sie gefälschte Konten entfernen. Im letzten Quartal 2023 entfernte Facebook fast 700 Millionen gefälschte Social-Media-Konten nachdem im Vorquartal bereits 827 Millionen entfernt wurden. Doch egal, wie viele verdächtige Benutzer entfernt werden, es tauchen zweifellos weitere auf. Das Problem liegt eindeutig beim Anmeldevorgang.

Strengere Maßnahmen wie Identitätsüberprüfungen könnten dazu beitragen, die Zahl dieser betrügerischen Konten drastisch zu reduzieren. Um die Integrität politischer Diskussionen im Internet zu gewährleisten, bedarf es letztlich einer Zusammenarbeit zwischen Regierungen, Technologieunternehmen und den Nutzern selbst.

Nächste Schritte für sicherere Plattformen

Identity Verification (IDV)-Software bietet eine sichere Lösung zur Bekämpfung von botgesteuertem Online-Datenverkehr, indem sie strenge Protokolle zur Benutzerauthentifizierung und Identitätsüberprüfung durchsetzt. Diese Plattformen können mehrere wichtige Maßnahmen implementieren:

Dokumentenprüfungen: Bei diesen Prüfungen wird die Echtheit und Gültigkeit der vorgelegten Identität durch die Untersuchung offizieller Dokumente wie Reisepässe sichergestellt, um deren Rechtmäßigkeit zu bestätigen.

Biometrische Verifizierung: Biometrische Prüfungen gehen noch einen Schritt weiter, indem sie subtile Mikroausdrücke im Gesicht analysieren, um sicherzustellen, dass die Person, die das Dokument vorlegt, der rechtmäßige Besitzer ist. Die Technologie zur Erkennung von Lebendigkeit überprüft außerdem, ob der Benutzer physisch anwesend ist und es sich nicht um einen Bot oder eine Aufzeichnung handelt.

Altersüberprüfung: Der Schutz Minderjähriger ist für die Schaffung sichererer Online-Umgebungen von entscheidender Bedeutung. Die Altersüberprüfung trägt dazu bei, sicherzustellen, dass Benutzer die Altersanforderungen erfüllen, und verringert das Risiko der Ausbeutung oder der Exposition gegenüber schädlichen Inhalten.

Durch die Integration dieser Techniken können IDV-Plattformen die Bot-Aktivität erheblich reduzieren und so Social-Media-Bereiche vor Missbrauch schützen. Diese Maßnahmen stellen sicher, dass nur echte Benutzer Konten erstellen, und dämmen die Verbreitung von Spam, Fehlinformationen und anderen böswilligen Aktivitäten ein.

Weitere Informationen zum Schutz Ihrer Online-Plattform vor Bot-Betrug erhalten Sie bei unserem Expertenteam für Compliance.