En 2024, el fraude digital se ha disparado a nivel mundial, y tanto las empresas como los particulares se enfrentan a una amenaza en constante evolución que ha empezado a salirse de control. La IA ha permitido a los estafadores crear identidades falsas muy engañosas, aprovechando tecnologías como las deepfakes para cometer sofisticados ataques de presentación durante los procesos de incorporación de clientes, lo que suele tener graves consecuencias financieras. Con 2025 en el horizonte, ¿para qué tipos de delitos digitales deben prepararse las empresas y qué pueden hacer para fortalecer sus defensas?

Varias formas clave de delitos digitales dominarán los intentos de fraude en el próximo año, incluidos deepfakes cada vez más sofisticados, fraudes en redes sociales, ataques de phishing dirigidos por IA generativa, identidades comprometidas y más. Además, a medida que las tecnologías como la IA generativa se vuelven más fáciles de usar, la cantidad de actores maliciosos continúa aumentando. La barrera de entrada en términos de cometer ataques fraudulentos se ha reducido sustancialmente, con herramientas como DeepFakeLab disponibles públicamente para que cualquiera pueda crear un deepfake elegido.

Ataques de presentación sofisticados: deepfakes

Los ataques deepfakes ya no son algo poco común, ya que existen varias herramientas disponibles en línea que cualquiera puede usar para crear uno. Su prevalencia en línea ha aumentado drásticamente en los últimos años, y un informe de Deloitte Aumento de 700% solo en incidentes de deepfake en fintech en 2023.

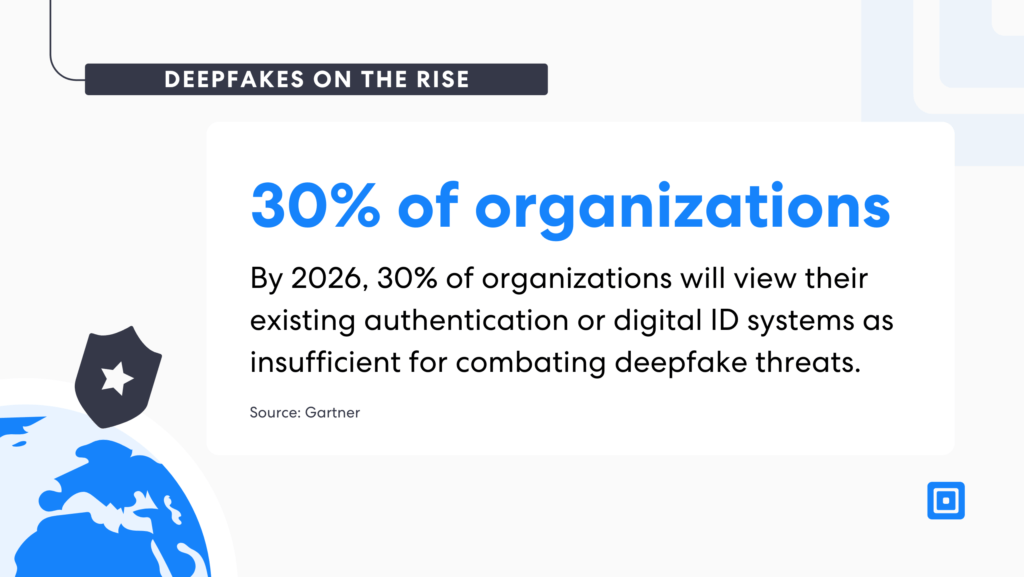

Para el año 2026, 30% de organizaciones considerarán que sus sistemas existentes de autenticación o identificación digital son insuficientes para combatir las amenazas de deepfake.

Un informe de Ofcom de 2024 reveló que 60% de personas En el Reino Unido se han encontrado al menos con un deepfake. Además, Gartner predice que para 2026, 30% de organizaciones considerarán que sus sistemas existentes de autenticación o identificación digital son insuficientes para combatir las amenazas de deepfake.

Akif Khan, analista vicepresidente de Gartner, afirma: "En la última década, se han producido varios puntos de inflexión en los campos de la IA que permiten la creación de imágenes sintéticas. Estas imágenes generadas artificialmente de rostros de personas reales, conocidas como deepfakes, pueden ser utilizadas por actores maliciosos para socavar la autenticación biométrica o hacerla ineficiente. Como resultado, las organizaciones pueden comenzar a cuestionar la confiabilidad de las soluciones de verificación y autenticación de identidad, ya que no podrán determinar si el rostro de la persona que se está verificando es un persona viva o un deepfake."

Los humanos a menudo no pueden diferenciar una deepfake de una persona viva, por lo que las organizaciones deben comenzar a invertir fuertemente en software de detección de vida de última generación. Tecnologías de detección de vida Puede identificar deepfakes analizando la textura de la piel, microexpresiones sutiles y más cosas que son indetectables para el ojo humano o para procesos simples de verificación de identidad.

Las plataformas de redes sociales como nuevo escenario para los delitos cibernéticos

Además de agilizar las prácticas de verificación de identidad, el sistema de identificación electrónica también sienta las bases para una rápida digitalización de la identidad. Es de conocimiento público que las plataformas de redes sociales son el punto de partida de muchos delitos modernos, y Facebook admitió haber eliminado 700 millones de cuentas falsas en redes sociales en el cuarto trimestre de 2023, después de haber eliminado 827 millones en el trimestre anterior. Sin duda, en 2025, esta tendencia continuará a medida que la cantidad de usuarios de redes sociales siga aumentando.

Las herramientas de inteligencia artificial generativa también permitirán a los estafadores llevar a cabo ataques de suplantación de identidad con un estándar más alto, lo que pone a los usuarios de las redes sociales en un mayor riesgo de convertirse en víctimas de prácticas como estafas de catfishing y matanza de cerdos. Los modelos de lenguaje avanzados como Chat GPT pueden generar texto que imita el estilo de escritura de alguien, lo que permite a los estafadores suplantar la identidad de una persona en mensajes o publicaciones. De manera similar, la inteligencia artificial se puede utilizar para crear automáticamente una gran cantidad de cuentas falsas en plataformas de redes sociales, utilizando perfiles con nombres, imágenes y fondos que suenen realistas.

Casi 80% de estafas empezar en linea.

Un portavoz de Lloyds habló recientemente con The Sunday Times y afirmó que “casi el 80% de las estafas comienzan en línea, y desde hace mucho tiempo pedimos que las redes sociales y las empresas de tecnología hagan más para proteger a sus usuarios y ayudar a reembolsar el dinero a víctimas inocentes”.

Hasta el momento, no hemos visto que las plataformas de redes sociales implementen plenamente los controles de seguridad necesarios, ya que no podría ser más fácil crear una cuenta de Instagram o Facebook con una identidad falsa. Sin embargo, si estas plataformas implementaran procesos de registro más estrictos con la prueba de identidad como requisito, los casos de fraude disminuirían.

Ataques de phishing respaldados por IA generativa

Las amenazas de phishing potenciadas por IA adoptan muchas formas, desde correos electrónicos generados con gramática impecable e inclusión de datos personales hasta malware altamente adaptable que puede aprender y evadir los sistemas de detección. Esta próxima generación de ataques de phishing aprovechará la capacidad de la IA para aprender de los datos en tiempo real y adaptarse en respuesta a la evolución de las medidas de seguridad, lo que dificulta aún más la detección.

Además de la calidad de los ataques de phishing, la cantidad de estos ataques también aumentará con la ayuda de la IA generativa. La IA generativa permitirá que se realicen miles de ataques de phishing dirigidos de forma simultánea, sin comprometer la personalización dirigida para lograr el máximo efecto. Los estafadores llevarán a cabo operaciones a gran escala, con muchas más posibilidades de éxito. Además, a medida que cometer fraudes sea más fácil con la ayuda de la IA y se necesiten menos conocimientos técnicos, comenzarán a surgir más estafadores.

La investigación que publicamos a principios de este año mostró que el 60% de los participantes fue víctima de phishing automatizado por inteligencia artificial (IA), lo que es comparable a las tasas de éxito de los mensajes de phishing no automatizados creados por expertos humanos. ~ Harvard Business Review

A principios de 2024, Harvard Business Review publicó una investigación que destacaba la tasa de éxito mucho mayor de los correos electrónicos de phishing mejorados con IA, con un 60% de participantes que fueron víctimas de estas estafas. Afirman: "Quizás aún más preocupante, nuestra nueva investigación demuestra que todo el proceso de phishing se puede automatizar utilizando LLM, lo que reduce los costos de los ataques de phishing al Más de 95% mientras se logran tasas de éxito iguales o mayores”. Esto sugiere que los ataques de phishing no solo mejorarán en calidad, sino también en cantidad, con una gran cantidad de ataques llevados a cabo en todo el mundo en todas las industrias.

Ataques a las cadenas de suministro:

A medida que nos acercamos a 2025, se espera que los ataques a la cadena de suministro se vuelvan más sofisticados, y los cibercriminales se dirijan a proveedores más pequeños y menos seguros para obtener acceso a organizaciones más grandes. Estos ataques pueden implicar fraude impulsado por IA, ransomware, exfiltración de datos e incluso la interrupción de la infraestructura crítica. El Centro Nacional de Seguridad Cibernética del Reino Unido afirma: "En los últimos años ha habido un aumento significativo en la cantidad de ataques cibernéticos resultantes de vulnerabilidades dentro de la cadena de suministro“Estos ataques pueden tener consecuencias devastadoras, costosas y a largo plazo para las organizaciones afectadas, sus cadenas de suministro y sus clientes”.

Tendencias clave en ataques a la cadena de suministro:

- Ataques potenciados por IA:Los estafadores utilizarán herramientas de inteligencia artificial para crear comunicaciones falsas, phishing y deepfakes, lo que dificultará la detección.

- Dirigido a proveedores más pequeños:Los ciberdelincuentes explotarán los eslabones más débiles de la cadena de suministro para infiltrarse en organizaciones más grandes.

- Ransomware y robo de datos:Los atacantes pueden tomar sistemas como rehenes o robar datos confidenciales para exigir un rescate.

- Interrupción de infraestructura críticaLos ataques a la cadena de suministro pueden tener como objetivo sectores como el energético o la atención sanitaria y causar daños generalizados.

Fortaleciendo las operaciones con un KYC sólido

Los procesos KYC (Conozca a su cliente) pueden ser fundamentales para mitigar muchas de las amenazas emergentes de fraude digital que las empresas enfrentarán en 2025, como deepfakes, fraude en redes sociales, phishing impulsado por IA y ataques a la cadena de suministro.

Lucha contra las deepfakes:KYC puede fortalecer la verificación de identidad al garantizar que las personas que se incorporan sean quienes dicen ser. Al integrar detección de vida Con KYC, las empresas pueden evitar el fraude basado en deepfakes durante la creación de cuentas o transacciones financieras, lo que dificulta que los estafadores se hagan pasar por clientes legítimos. Para obtener más información sobre el aumento de deepfakes, lea “Software de detección de deepfakes: prevención de contenido fraudulento.“

Cómo prevenir el phishing mediante inteligencia artificial:Los datos KYC ayudan a garantizar que las comunicaciones (correos electrónicos, mensajes, etc.) que implican acciones sensibles, como transferencias bancarias o cambios de cuenta, estén autenticadas. Al verificar la identidad de la persona detrás de cada solicitud, las empresas pueden identificar mejor los intentos de phishing generados por IA, que se basan en imitar patrones de comunicación humanos.

Asegurando la cadena de suministro:KYC se puede utilizar para verificar la legitimidad de proveedores externos, asegurándose de que no estén vinculados a actividades fraudulentas o delictivas. Al realizar una debida diligencia exhaustiva con todos los proveedores, las empresas pueden reducir el riesgo de ataques a la cadena de suministro que se aprovechan de los vínculos más débiles para infiltrarse en organizaciones más grandes.

Para obtener más información sobre cómo fortalecer sus operaciones con una infraestructura KYC de última generación, comuníquese con uno de los ComplyCube expertos en cumplimiento hoy.