El aumento de los fraudes deepfake ha introducido una nueva dimensión de riesgo para las empresas, erosionando los cimientos de la confianza digital. Estas manipulaciones generadas por IA, capaces de imitar el habla, las expresiones faciales y los gestos con una precisión sorprendente, ya no están limitadas a los expertos cualificados. Las herramientas de código abierto han democratizado la creación de deepfakes, permitiendo que incluso aquellos con un mínimo de conocimientos técnicos produzcan vídeos e imágenes falsas convincentes, lo que amplifica su amenaza en las plataformas de redes sociales. Para las empresas, las consecuencias de los ataques deepfake son de gran alcance, desde fraude financiero y violaciones de datos hasta daños a la reputación y pérdida de confianza de las partes interesadas. A medida que estas amenazas evolucionan, las herramientas de detección de deepfakes se han vuelto indispensables. Esta guía examina cómo estas herramientas ayudan a las empresas a proteger sus operaciones, asegurar la confianza de las partes interesadas, realizar evaluaciones integrales y mantenerse resilientes ante las amenazas emergentes.

¿Qué son los deepfakes?

Los deepfakes son vídeos, imágenes o grabaciones de audio creados o alterados artificialmente y diseñados para parecer y sonar completamente reales. Se generan mediante técnicas avanzadas de inteligencia artificial (IA), lo que permite a los estafadores manipular la apariencia, la voz o incluso el comportamiento de una persona en contenido digital. A diferencia de las imágenes simples generadas por IA y manipuladas inocentemente, los deepfakes pueden crear identidades completamente nuevas y falsificar escenarios del mundo real al reemplazar el rostro o la voz de una persona por la de otra.

Lo que hace que los deepfakes sean especialmente peligrosos es su conexión con fraude de identidad sintéticaEn estos esquemas, los estafadores combinan información real y falsa (por ejemplo, combinando un número de seguridad social real con datos personales inventados o un nombre falso) para crear una identidad falsa. Este perfil sintético puede luego usarse para eludir controles de seguridad, abrir cuentas fraudulentas o llevar a cabo delitos financieros, lo que hace que la detección de deepfakes sea extremadamente difícil sin herramientas especializadas.

46% de organizaciones En 2022, todo el mundo se enfrentó al fraude de identidad sintética.

En 2022, un total de 461.000 organizaciones a nivel mundial se enfrentaron a fraudes de identidad sintética, y esa cifra sigue creciendo, lo que les cuesta a las empresas cantidades exorbitantes de dinero y compromete información confidencial de víctimas desprevenidas.

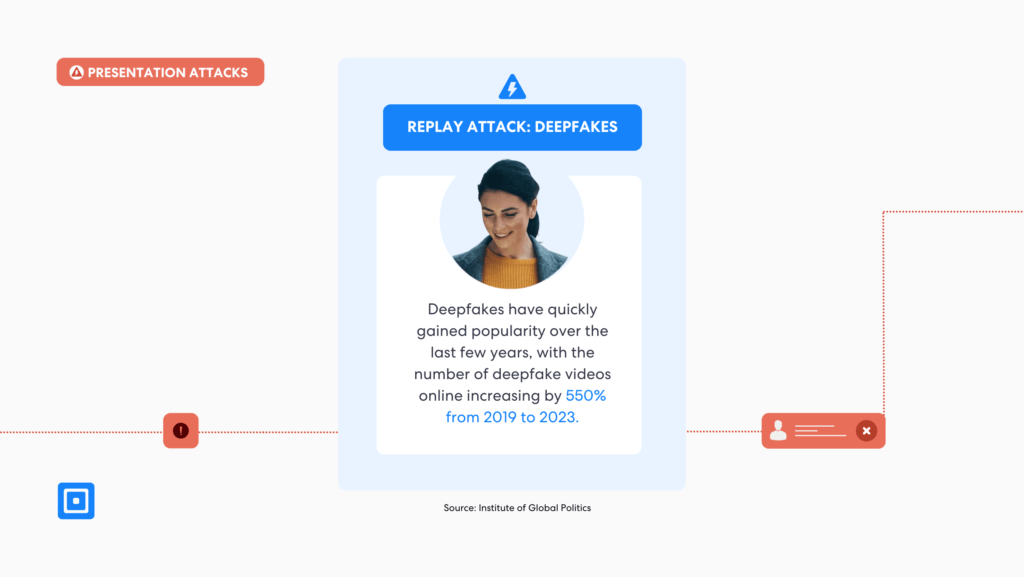

Desde transacciones financieras fraudulentas hasta sabotaje a la reputación, los deepfakes se han convertido en una herramienta poderosa para actores maliciosos. Como lo señaló el Instituto Buffett de Asuntos Globales de Northwestern, “En un mundo plagado de desinformación y desconfianza, la IA proporciona medios cada vez más sofisticados para convencer a la gente de la veracidad de información falsa que tiene el potencial de conducir a una mayor tensión política, violencia o incluso guerra”. Esta realidad aleccionadora revela no solo la nueva amenaza de la amenaza técnica que plantean los deepfakes, sino su impacto social más amplio.

Manipulación de deepfakes en plataformas de redes sociales

La calidad hiperrealista de los deepfakes suele engañar a los espectadores y eludir los métodos de detección tradicionales. A medida que estas manipulaciones se vuelven más convincentes, se necesitan tecnologías avanzadas para identificar los marcadores sutiles de los videos y el contenido deepfake.

El uso de la IA y el aprendizaje automático en la creación de deepfakes

En esencia, los deepfakes se crean utilizando técnicas avanzadas y profundas de aprendizaje automático, principalmente redes generativas antagónicas (GAN) y redes neuronales. Estos sistemas están diseñados para replicar y manipular rasgos, expresiones y habla humanos con una precisión notable. Para simplificar, una GAN funciona como una competencia continua entre dos sistemas de inteligencia artificial (IA): el generador y el discriminador.

El generador actúa como un artista altamente calificado, utilizando métodos de aprendizaje automático para crear imágenes, videos o audio falsos. Lo hace analizando conjuntos de datos masivos llenos de ejemplos de rasgos faciales, patrones de voz y movimientos de labios del mundo real. Por ejemplo, estudia cómo se mueve la boca cuando se dicen ciertas palabras, cómo se ve la textura de la piel en diferentes condiciones de iluminación y cómo se mueven los músculos faciales durante las expresiones. Con el tiempo, el generador aprende a imitar estos detalles con una precisión cada vez mayor.

El discriminador, por otro lado, actúa como un crítico meticuloso. Evalúa el contenido creado por el generador, analizando cada detalle (hasta las inconsistencias sutiles en los movimientos de los labios, las transiciones del tono de la piel o los reflejos de los ojos) para determinar si el resultado es auténtico o sintético. El trabajo del discriminador es señalar cualquier cosa que parezca fuera de lugar.

El generador va perfeccionando su trabajo en función de la información que recibe del discriminador. Con el tiempo, este proceso de ida y vuelta mejora la capacidad del generador para producir contenido tan convincente que incluso el discriminador tiene dificultades para determinar si se trata de contenido falso. Este ciclo continuo es lo que hace que los deepfakes sean cada vez más realistas y difíciles de detectar sin herramientas especializadas.

Técnicas de intercambio de rostros y sus implicaciones para la detección de deepfakes

Uno de los usos más conocidos de la tecnología deepfake es el intercambio de rostros, en el que el rostro de una persona se superpone al de otra en un video. Estas manipulaciones pueden hacer que parezca que alguien ha dicho o hecho cosas que en realidad nunca hizo, lo que las convierte en una poderosa herramienta para las campañas de desinformación. Sin embargo, las implicaciones se extienden mucho más allá de la desinformación.

Esta nueva tecnología también ha dado lugar al phishing deepfake, una forma particularmente insidiosa de ciberdelito. Según Stu Sjouwerman, experto de la industria y colaborador de Forbes sobre seguridad en Internet, “Se sabe que los estafadores evolucionan sus tácticas en línea con la evolución de la tecnología. En los últimos años, el phishing ha cambiado de forma nuevamente, utilizando una tecnología que algunos expertos llaman la forma más peligrosa de ciberdelito impulsado por IA en el mundo”.

Los deepfakes son una de las amenazas emergentes más graves. riesgos.

Esta evaluación está respaldada por Un estudio En un estudio realizado por el University College London (UCL), 31 expertos clasificaron las amenazas más importantes que plantean los delitos impulsados por IA. La investigación, financiada por el Centro Dawes para el Delito del Futuro del UCL, destacó las deepfakes como uno de los riesgos emergentes más graves. Entre los 20 usos nefastos de la IA identificados, las deepfakes se destacaron por su potencial para causar daños generalizados en los próximos 15 años.

La accesibilidad de la tecnología de detección de deepfakes y sus riesgos

La proliferación de herramientas de código abierto para la creación de deepfakes ha hecho que esta tecnología sea accesible a un público más amplio. Incluso personas con conocimientos técnicos mínimos pueden ahora producir deepfakes utilizando software como Laboratorio DeepFace, un sistema que alimenta más de 95% de creaciones deepfake. Esta accesibilidad significa que las amenazas deepfake ya no se limitan a desarrolladores altamente capacitados u organizaciones cibercriminales bien financiadas, sino que ahora son una amenaza cibernética generalizada que puede surgir de prácticamente cualquier persona con una computadora y una conexión a Internet.

Gartner ha comentado sobre los riesgos que presentan las deepfakes para las empresas a nivel mundial, afirmando: "En la última década, se han producido varios puntos de inflexión en los campos de la IA que permiten la creación de imágenes sintéticas. Estas imágenes generadas artificialmente de rostros de personas reales, conocidas como deepfakes, pueden ser utilizadas por actores maliciosos para socavar la autenticación biométrica o hacerla ineficiente", dijo Akif Khan, analista de Gartner. “Como resultado, las organizaciones pueden comenzar a cuestionar la confiabilidad de las soluciones de verificación y autenticación de identidad, ya que no podrán determinar si el rostro de la persona que se está verificando es una persona viva o una falsificación profunda”.

La propagación viral de deepfakes: el papel de las redes sociales

Una vez creados, los deepfakes pueden propagarse rápidamente en varias plataformas de redes sociales, aprovechando narrativas controvertidas o cargadas de emoción para ganar fuerza. Esta viralidad exacerba el desafío de mitigar su impacto, ya que pueden influir en la percepción pública antes de ser detectados.

Fraude financiero y esquemas habilitados para deepfakes

Cada vez se utilizan más las deepfakes como arma, lo que genera riesgos importantes para las empresas. Los estafadores han utilizado audio y video deepfake para hacerse pasar por ejecutivos y engañar a los empleados para que transfieran fondos o divulguen información confidencial.

Un caso notable Ocurrió en Hong Kong, donde un empleado de finanzas de una empresa multinacional fue engañado para que transfiriera $25 millones. Según la policía de Hong Kong, los atacantes utilizaron tecnología deepfake para hacerse pasar de manera convincente por el director ejecutivo de la empresa durante una videoconferencia.

Los medios manipulados pueden dañar gravemente la imagen de marca de una empresa. Un video deepfake que retrate a un director ejecutivo en una situación comprometedora, por ejemplo, podría provocar una reacción negativa del público y erosionar la confianza entre las partes interesadas.

Desafíos y direcciones futuras en la lucha contra los deepfakes

Lamentablemente, muchos algoritmos de detección deficientes enfrentan desafíos como las altas tasas de falsos positivos y la creciente sofisticación de las tecnologías de creación de deepfakes. Las actualizaciones continuas y la colaboración entre empresas y desarrolladores de tecnología son esenciales para mantenerse a la vanguardia de estas amenazas.

Para detectar deepfakes en tiempo real, adquirir y analizar una gran cantidad de datos conjunto de datos imparcial es necesario

Como se señala en el estudio 'Detección de vídeos deepfake: desafíos y oportunidades' (Kaur y otros, 2024),“A pesar del progreso significativo en los videos deepfake y los algoritmos de detección, varios desafíos cruciales siguen sin resolverse para los métodos actuales de detección de videos deepfake. Para detectar deepfakes en tiempo real, es necesario adquirir y analizar un conjunto de datos grande e imparcial. La recopilación de datos en tiempo real es una de las principales limitaciones del método basado en Deep Learning (DL). Desafortunadamente, muchas áreas de aplicación en tiempo real no pueden acceder a grandes cantidades de datos nuevos”.

Esto muestra un problema clave con la mayoría de los sistemas de detección de deepfakes: las herramientas son tan efectivas como los conjuntos de datos con los que están entrenadas. Sin acceso a datos diversos y actualizados, incluso los modelos de detección de IA avanzados tienen dificultades para seguir el ritmo de los deepfakes cada vez más sofisticados. Las empresas no solo deben invertir en tecnologías confiables de detección de deepfakes, sino también respaldar mejores prácticas de intercambio de datos y colaboración entre industrias para abordar esta brecha.

Herramientas de detección de deepfake para salvaguardar la confianza digital

Para hacer frente al desafío de la manipulación de deepfakes, las empresas deben adoptar herramientas y software de detección de deepfakes avanzados. Estos sistemas se basan en una combinación de técnicas de aprendizaje profundo y algoritmos de aprendizaje automático para analizar meticulosamente los medios digitales (incluidas imágenes, videos y audio) en busca de señales de contenido generado o manipulado.

95% de todos Los procesos estándar de incorporación de clientes no detectan la presencia de identificación falsa.

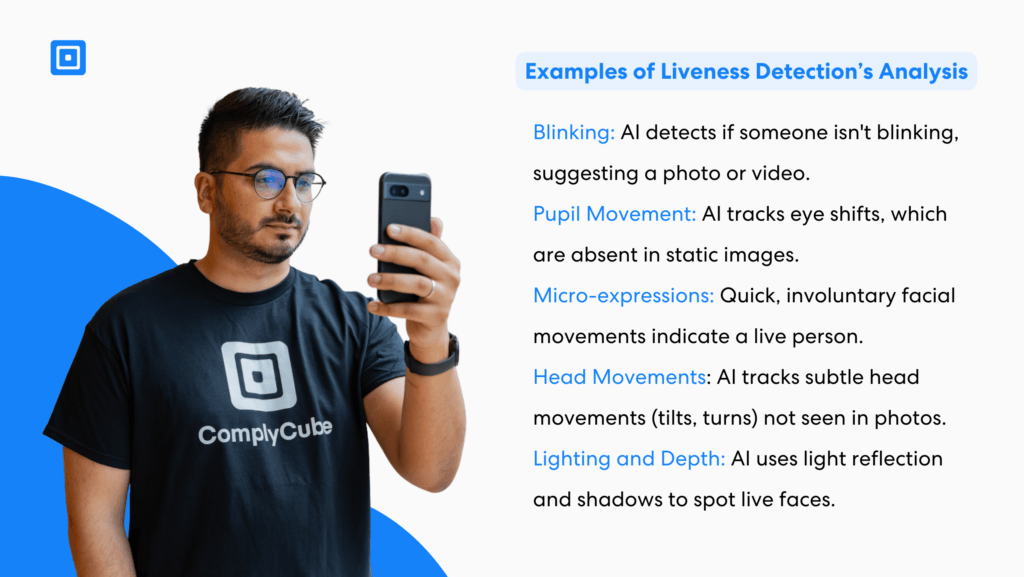

Una innovadora plataforma de detección de deepfakes en este espacio es ComplyCube. Tecnología de detección de vida Establece un nuevo punto de referencia en la verificación biométrica, verificando que los datos biométricos provienen de una persona real y viva en lugar de imágenes estáticas, videos pregrabados o deepfakes generados por IA.

Gracias a algoritmos avanzados de inteligencia artificial y aprendizaje automático, analiza microexpresiones, texturas de la piel, patrones de reconocimiento facial e interacciones ambientales en tiempo real. A través de un enfoque multimodal (que combina controles activos, como movimientos de cabeza guiados, con análisis pasivos que funcionan silenciosamente en segundo plano), ComplyCube detecta sin problemas intentos de suplantación sofisticados, incluidas fotos impresas, máscaras 3D y repeticiones de videos. Este sólido sistema ofrece una verificación de identidad sumamente precisa, segura y sin inconvenientes, lo que permite a las empresas prevenir el fraude con confianza.

Cómo generar resiliencia frente a las amenazas de deepfake con herramientas de detección de deepfake

Los deepfakes representan un desafío formidable para la confianza digital, en particular para las empresas que se esfuerzan por mantener operaciones seguras y confiables. Al adoptar herramientas avanzadas de detección de deepfakes e integrarlas en marcos integrales de ciberseguridad, las organizaciones pueden mitigar los riesgos que plantean los medios manipulados.

ComplyCube es una potente plataforma diseñada para abordar el creciente desafío de la detección de deepfakes aprovechando técnicas avanzadas de aprendizaje automático y tecnologías de aprendizaje profundo. Al combinar el reconocimiento facial, el análisis de documentos y las medidas contra la suplantación de identidad, la plataforma garantiza una verificación de identidad segura y confiable, incluso en una era en la que detectar videos deepfake es cada vez más difícil.

Reconocimiento facial robusto y análisis de similitudes: ComplyCube utiliza detección biométrica de vida certificada por ISO 30107-3 y PAD Nivel 2 para garantizar un reconocimiento facial preciso. Al comparar videos reales y muestras de datos biométricos, la herramienta distingue de manera efectiva a los usuarios genuinos de las identidades manipuladas. Sus capacidades de detección de deepfake se mejoran al analizar rasgos faciales, patrones de comportamiento y otras señales biológicas únicas, lo que crea una capa adicional de garantía de verificación.

Verificación avanzada de documentos: Mediante una combinación de técnicas avanzadas de aprendizaje automático y experiencia humana, ComplyCube analiza una amplia gama de documentos de identidad, como pasaportes, licencias de conducir, tarjetas de identificación nacionales, permisos de residencia y sellos de visa. Este proceso de verificación implica la comparación de documentos con conjuntos de datos confiables para identificar signos de manipulación, falsificación o inclusión en listas negras, y garantizar que sean auténticos y no hayan sido alterados.

Tecnología de vanguardia para detección de vida:Con la detección de vida de nivel 2 de PAD impulsada por IA, ComplyCube puede detectar videos deepfake y evitar intentos de suplantación de identidad. Este sistema utiliza algoritmos anti-spoofing para identificar discrepancias sutiles entre videos reales y medios manipulados, lo que protege contra desafíos de detección de deepfake cada vez más sofisticados.

Integración biométrica sin inconvenientes: ComplyCube ofrece una experiencia de captura facial guiada, lo que agiliza el proceso de integración biométrica para sectores como finanzas, telecomunicaciones, viajes y servicios empresariales. Al centrarse en la integración de conjuntos de datos de alta calidad y la optimización continua del sistema, la herramienta ofrece un proceso de autenticación preciso y sin inconvenientes.

Ante las crecientes amenazas de contenido falso generado por IA, un socio como ComplyCube desempeña un papel esencial en el fortalecimiento de la confianza digital. Su enfoque integral en el reconocimiento facial, la verificación de documentos y la detección de deepfakes ayuda a las organizaciones a mantenerse a la vanguardia de los desafíos y, al mismo tiempo, garantizar la integridad de sus procesos de verificación de identidad.

Contacte con uno de los ComplyCube expertos en cumplimiento hoy para obtener más información sobre cómo proteger su organización.