La política global depende de narrativas cambiantes que millones de personas reescriben cada día, a medida que nuestras opiniones se reconfiguran en función de lo último que leemos en Twitter. Cuando lo que leemos son las opiniones de personas reales de todos los ámbitos de la vida, sin duda estamos cosechando los beneficios de la libertad de expresión, un uso claramente democrático de la tecnología. Sin embargo, cuando lo que leemos es consecuencia de la falta de controles de identidad necesarios y de bots fraudulentos en las redes sociales, es todo menos democrático: es un intento de controlar un espacio que debería ser nuestro. La falta de prácticas de verificación de las redes sociales en las plataformas en línea ha permitido que actores maliciosos dirijan los debates globales, a menudo difundiendo información falsa para lograr una agenda política específica. Por lo tanto, la implementación de la detección de cuentas falsas en las redes sociales se ha vuelto fundamental.

Las cuentas falsas y los bots han estado estrechamente vinculados a la política internacional durante mucho tiempo, causando controversia mundial durante la última década. Cientos, si no miles, de artículos de noticias han informado sobre el aumento de la actividad de bots en las plataformas sociales antes de las elecciones. Antes de las elecciones de 2024 en el Reino Unido, artículos como el artículo de Global Witness, "Investigación revela que se ha visto contenido publicado por cuentas similares a bots en X 150 millones de veces De cara a las elecciones del Reino Unido”, destacó cómo las opiniones del público en general no serían el único factor decisivo.

Curiosamente, no sólo las plataformas de medios de comunicación se han pronunciado sobre el tráfico político impulsado por bots, sino que también los académicos han tomado el asunto en sus propias manos en los últimos 20 años. En los primeros debates sobre el software bot malicioso, T. Holz escribió un artículo crítico en 2005, "Una breve visita al zoológico de bots". Este fue uno de los primeros artículos en abordar los ataques de bots en línea, que en ese momento se usaban principalmente para el robo masivo de identidad, los ataques distribuidos de denegación de servicio (DDoS) o el envío de spam.

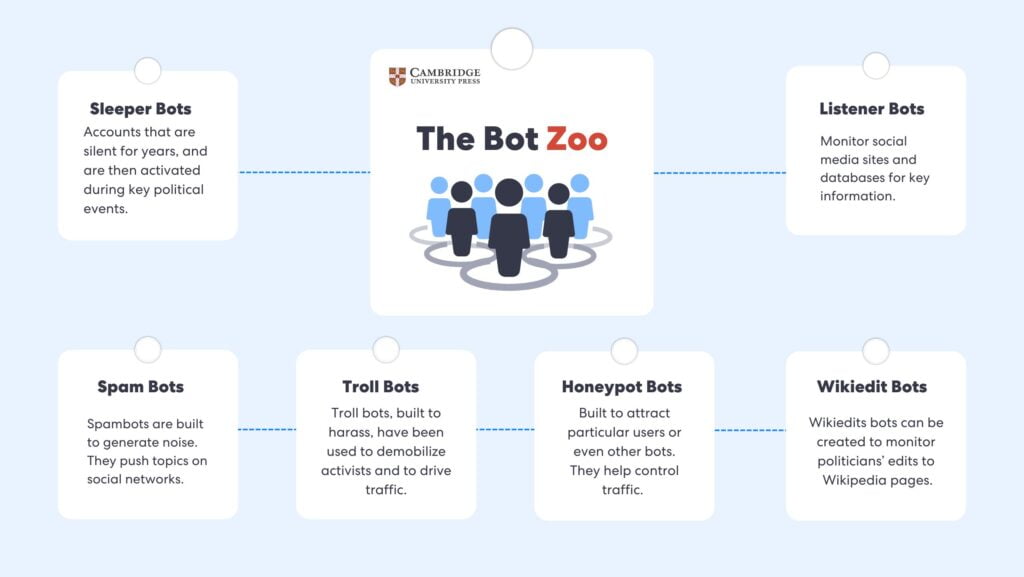

Holz logró captar las características clave de estos bots, describiendo sus rasgos y comportamientos. También creó una estructura que podía categorizar diferentes tipos de bots. Los académicos de Cambridge tomaron el trabajo de Holz en 2020, así como muchos otros artículos y estudios destacados sobre el comportamiento de los bots desde 2005, y crearon de manera similar su propia clasificación, centrándose específicamente en la actividad en línea de los bots políticos.

Un zoológico de robots políticos

Los académicos de Cambridge University Press han escrito extensamente sobre el uso y las amenazas de los bots políticos. Samuel C. Woolley logró avances reales en su artículo de 2020, “Bots and Computational Propaganda: Automatización para comunicación y control.” Afirma en este artículo que “la presencia [de] bots sociales en el debate político en línea puede crear tres problemas tangibles: primero, la influencia puede redistribuirse entre cuentas sospechosas que pueden operar con fines maliciosos; segundo, la conversación política puede polarizarse aún más; tercero, puede aumentar la difusión de información errónea e información no verificada”.

Continúa replicando la clasificación Bot-Zoo original de Holz, pero aplica el concepto a bots políticos, identificando las siguientes categorías:

- Bots oyentes: Pueden monitorear sitios de redes sociales y bases de datos para obtener información clave, pero también rastrear y comunicar lo que encuentran.

- Bots de spam: Los spambots, por el contrario, están diseñados para generar ruido.

- Bots de Wikiedit: Se pueden crear bots de Wikiedit para monitorear las ediciones que hacen los políticos en las páginas de Wikipedia.

- Bots durmientes: Los bots durmientes son cuentas de redes sociales que se encuentran en un sitio como Twitter, casi sin uso durante años, para generar una presencia en línea más realista. Luego se activan durante eventos políticos clave.

- Bots trolls: Los bots troll, diseñados para acosar, se han utilizado para trollear a activistas que intentan organizarse y comunicarse en Twitter, pero también pueden dirigir el tráfico de una causa, producto o idea a otra.

- Bots honeypot: Diseñado para atraer a determinados usuarios o incluso a otros bots.

La política moderna

La política moderna está cada vez más entrelazada con las plataformas de redes sociales, donde la batalla por la opinión pública suele estar influida por actores maliciosos en lugar de por un discurso genuino. La proliferación de bots y cuentas falsas ha cambiado el panorama de la participación política, permitiendo que la desinformación se propague a velocidades sin precedentes.

El incidente del globo espía chino (2024)

Un ejemplo de ello es un caso que tuvo lugar a principios de 2024, en el que ejércitos de bots se enfrentaron en las redes sociales por el incidente del globo espía chino. Investigadores de la Universidad Carnegie Mellon examinaron 1,2 millones de tuits relacionado con el incidente, encontrando algunos resultados interesantes.

Los tuits chinos fueron en su mayoría artificiales, ya que el 641% de ellos fueron escritos por bots. Sin embargo, Estados Unidos también utilizó bots para intentar desviar la culpa, ya que el 351% de sus tuits fueron escritos por bots. Este caso pone de relieve que gran parte del contenido que encontramos a diario en plataformas como Twitter o Facebook puede no ser fiable, ya que cada vez es más difícil distinguir entre información real y falsa.

Referéndum del Brexit (2016)

El Dr. Marco Bastos descubrió una red de bots de redes sociales que se utilizaron para saturar Twitter con mensajes electorales durante la campaña del referéndum del Brexit de 2016. La investigación descubrió que 13.493 cuentas tuitearon en las dos semanas anteriores y posteriores al referéndum.

Estas identidades falsas en línea expresaron opiniones e intentaron... manipular la opinión pública a través de tweets en rápida cascada.

Como era de esperar, estos perfiles desaparecieron después de que terminara la votación. La investigación de la City University sobre este caso afirma que “estas identidades falsas en línea expresaron opiniones e intentaron manipular la opinión pública mediante tuits en cascada”.

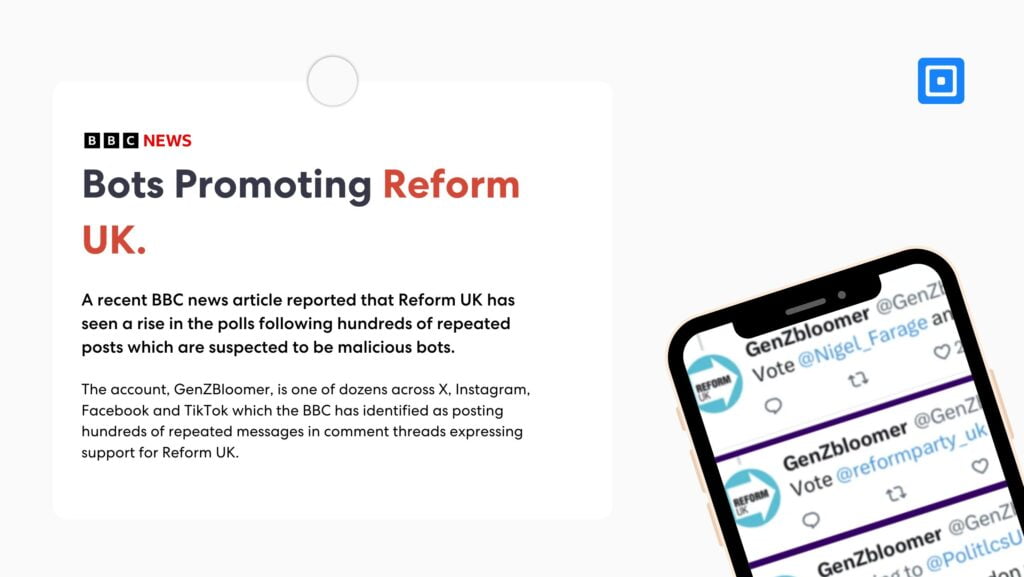

Los robots que promueven la reforma en el Reino Unido (2024)

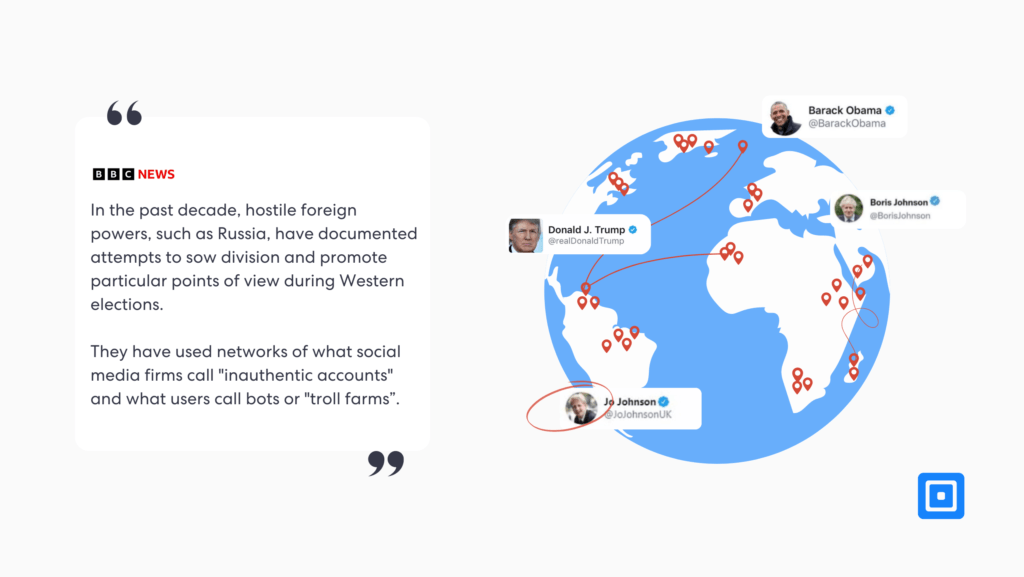

Un reciente Artículo de noticias de la BBC informó que Reform UK ha experimentado un aumento en las encuestas tras reiteradas publicaciones que se sospecha que fueron diseñadas por bots maliciosos. La BBC decidió investigar esto más a fondo y se puso en contacto con las personas detrás de las cuentas que claramente intentan exagerar la popularidad de Reform UK. Tras las preocupaciones sobre la interferencia extranjera en otras elecciones, la investigación concluyó que muchas de estas cuentas no eran auténticas.

El artículo de la BBC afirma: “En la última década, potencias extranjeras hostiles, como Rusia, han documentado intentos de sembrar división y promover puntos de vista particulares durante las elecciones occidentales. Han utilizado redes de lo que las empresas de redes sociales llaman 'cuentas no auténticas' y lo que los usuarios llaman bots o 'granjas de trolls'”.

Los investigadores han catalogado el uso de bots políticos como un refuerzo masivo de las métricas de las redes sociales de políticos y candidatos políticos. Donald Trump a Rodrigo Duterte.

Es difícil identificar el alcance de la influencia lograda por estas formas de manipulación, pero muchos periodistas y académicos han llegado a la conclusión de que ciertamente es significativa. Los académicos de Cambridge University Press informan que "los investigadores han catalogado el uso de bots políticos como un refuerzo masivo de las métricas de las redes sociales de los políticos y candidatos políticos de Donald Trump a Rodrigo Duterte”.

Poniendo la situación bajo control

Lo que hay que tener en cuenta es si las plataformas en línea están haciendo lo suficiente para frenar la propagación de contenido malicioso generado por bots. En particular, los períodos electorales parecen desencadenar un aumento de esa actividad, lo que indica una falta de sistemas sólidos de verificación de identidad.

Muchas plataformas de redes sociales parecen intentar solucionar el problema eliminando cuentas falsas. En el último trimestre de 2023, Facebook eliminó casi 700 millones de cuentas falsas en redes sociales Después de eliminar 827 millones en el trimestre anterior, no obstante, por más usuarios sospechosos que se eliminen, es indudable que vuelven a aparecer más. El problema está claramente en el proceso de registro.

Medidas más estrictas, como la verificación de identidad, pueden ayudar a reducir drásticamente la cantidad de cuentas fraudulentas. En definitiva, garantizar la integridad de los debates políticos en línea requerirá un esfuerzo colaborativo entre los gobiernos, las empresas tecnológicas y los propios usuarios.

Próximos pasos para plataformas más seguras

El software de verificación de identidad (IDV) ofrece una solución segura para combatir el tráfico en línea impulsado por bots al aplicar estrictos protocolos de autenticación de usuarios y verificación de identidad. Estas plataformas pueden implementar varias medidas clave:

Verificaciones de documentos: Estos controles verifican que la identidad presentada es auténtica y válida mediante el examen de documentos oficiales como pasaportes para confirmar su legitimidad.

Verificación biométrica:Los controles biométricos van un paso más allá al analizar las sutiles microexpresiones faciales para garantizar que la persona que presenta el documento sea el legítimo propietario. La tecnología de detección de vida también verifica que el usuario esté físicamente presente y no sea un robot o una grabación.

Verificación de edad: La protección de los menores es fundamental para crear entornos en línea más seguros. La verificación de edad ayuda a garantizar que los usuarios cumplan con los requisitos de edad, lo que reduce el riesgo de explotación o exposición a contenido dañino.

Al integrar estas técnicas, las plataformas de verificación de identidades pueden reducir significativamente la actividad de los bots, lo que protege los espacios de las redes sociales contra el uso indebido. Estas medidas garantizan que solo los usuarios reales creen cuentas, lo que frena la propagación de spam, desinformación y otras actividades maliciosas.

Para obtener más información sobre cómo proteger su plataforma en línea del fraude impulsado por bots, comuníquese con nuestro equipo experto en cumplimiento.