La technologie de l’IA est passée rapidement d’une nouveauté à une menace pour les processus socioéconomiques, politiques et démocratiques du monde entier via la fraude deepfake. Les logiciels de détection de deepfake, y compris les solutions de vérification d’identité (IDV) telles que la vérification de documents et la vérification biométrique, doivent être adoptés rapidement pour garantir que les économies, les gouvernements et notre vie quotidienne puissent continuer sans interruption.

L’impact des deepfakes sur les élections, la confiance du public et l’authenticité des entreprises est une préoccupation croissante. À l’approche de cycles électoraux critiques dans plusieurs démocraties, il est plus important que jamais de comprendre les dangers posés par cette technologie. Ce guide examine plus en détail la manière dont ces menaces se concrétisent et les meilleures pratiques pour les empêcher de s’abattre sur le monde numérique.

Qu'est-ce qu'un Deepfake ?

Les deepfakes tirent leur nom d'une méthodologie d'intelligence artificielle (IA), le deep learning. Un algorithme de deep learning est capable d'apprendre par lui-même à résoudre des problèmes extrêmement complexes en analysant de vastes ensembles de données. Ces algorithmes peuvent remplacer des visages par des images, des vidéos, des sons et toute autre forme de contenu numérique pour créer un contenu hyperréaliste mais factice.

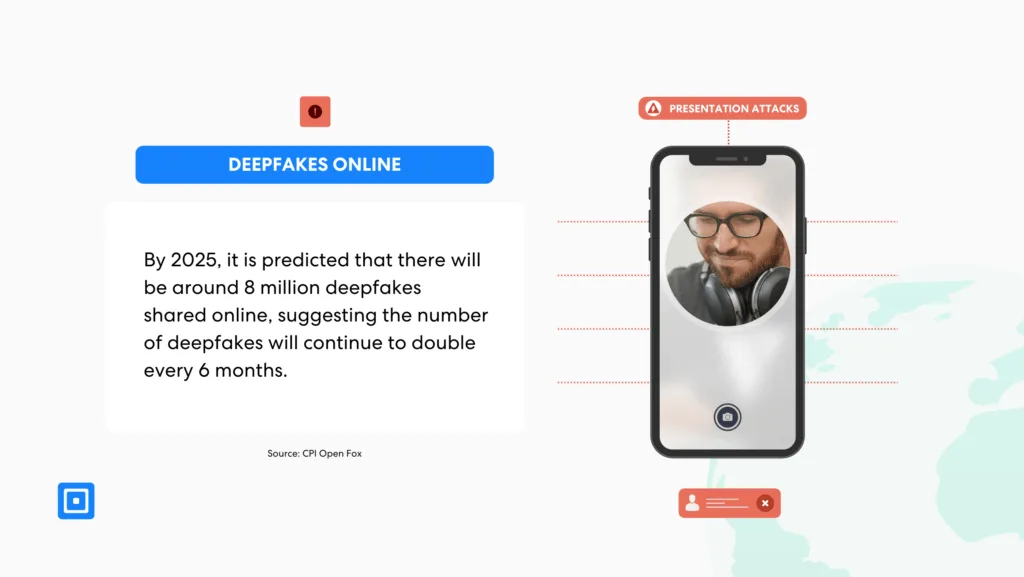

Le monde se dirige rapidement vers une crise du deepfake, avec de grandes craintes quant à l’impact que cette technologie d’IA aura et aura déjà sur l’environnement socioéconomique et politique mondial. Plus récemment, les craintes concernant l’intégrité des résultats des élections ont été examinées de près.

Qu'est-ce que la détection Deepfake ?

La détection de deepfakes est le processus utilisé pour identifier les images, les sons ou les vidéos créés artificiellement pour paraître hyperréalistes. En général, l'IA générative est utilisée dans les processus de vérification de documents et de vérification biométrique pour détecter des modèles dans le contenu deepfake qui n'existeraient pas dans le « contenu réel ».

Les solutions d’identification basées sur l’IA deviennent rapidement le seul moyen fiable de contrer la technologie deepfake et d’atténuer ce type de fraude à l’identité. Comparativement à un humain, ces technologies peuvent identifier le contenu falsifié beaucoup plus efficacement, en étant capables de traiter beaucoup plus de données sur une période donnée, avec beaucoup plus de précision et de manière beaucoup plus rentable.

En septembre 2023, trois agences clés chargées de l'application de la loi, la National Security Agency (NSA), le Federal Bureau of Investigation (FBI) et la Cybersecurity and Infrastructure Security Agency (CISA), ont publié un document déclarant que les menaces de deepfake avaient augmenté de manière exponentielle et que les technologies automatisées et préventives étaient essentielles.

Menaces provenant des médias synthétiques, tels que Les deepfakes ont augmenté de façon exponentielle.

La menace croissante des deepfakes à travers le monde et entre les différents secteurs d'activité exige de plus en plus de solutions robustes de vérification d'identité. De telles solutions nécessitent une intelligence artificielle générative (Gen AI) similaire pour alimenter des mesures préventives capables de contrer les menaces frauduleuses.

Vérification des documents

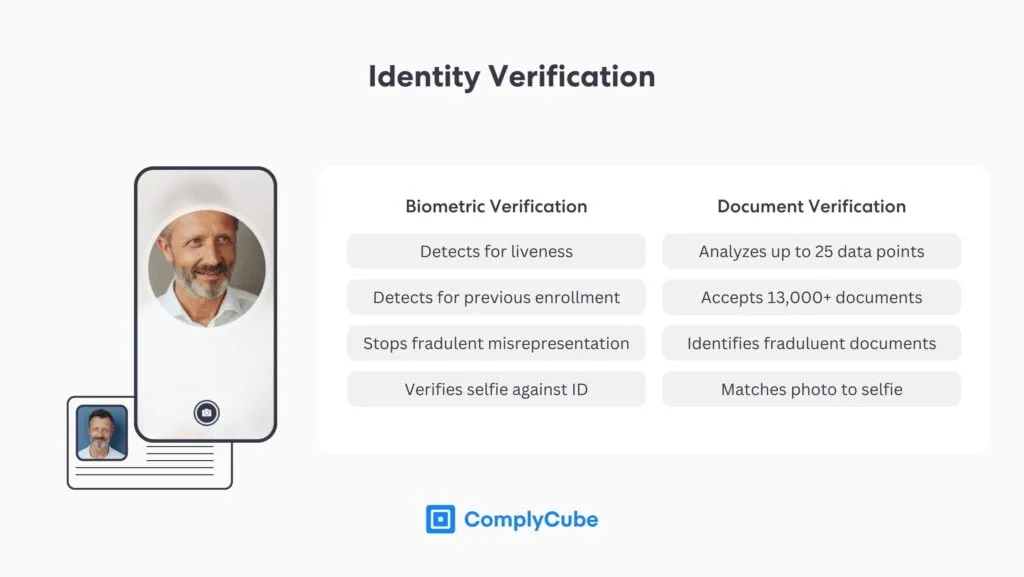

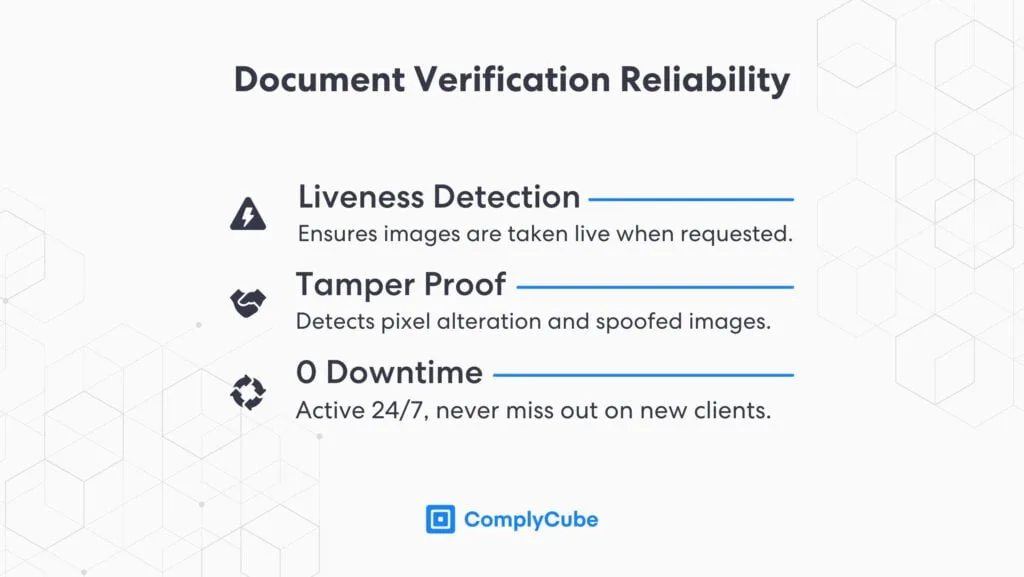

Vérification des documents est l'une des deux étapes clés des processus de lutte contre le blanchiment d'argent (AML), de connaissance du client (KYC) et de vérification de l'identité des clients. Ce processus utilise un moteur de vérification basé sur l'IA pour lire les documents KYC, tels qu'un permis de conduire, en moins de 15 secondes.

En vérifiant simultanément l'authenticité des documents et en extrayant les données disponibles, la vérification des documents offre un niveau élevé d'assurance d'identité. Elle agit également comme un système préliminaire robuste de détection de deepfakes, capable d'identifier les images créées artificiellement de cartes d'identité. Pour plus d'informations sur Gen AI et les méthodes de détection de deepfakes, lisez Fraude à l'IA générative et vérification d'identité.

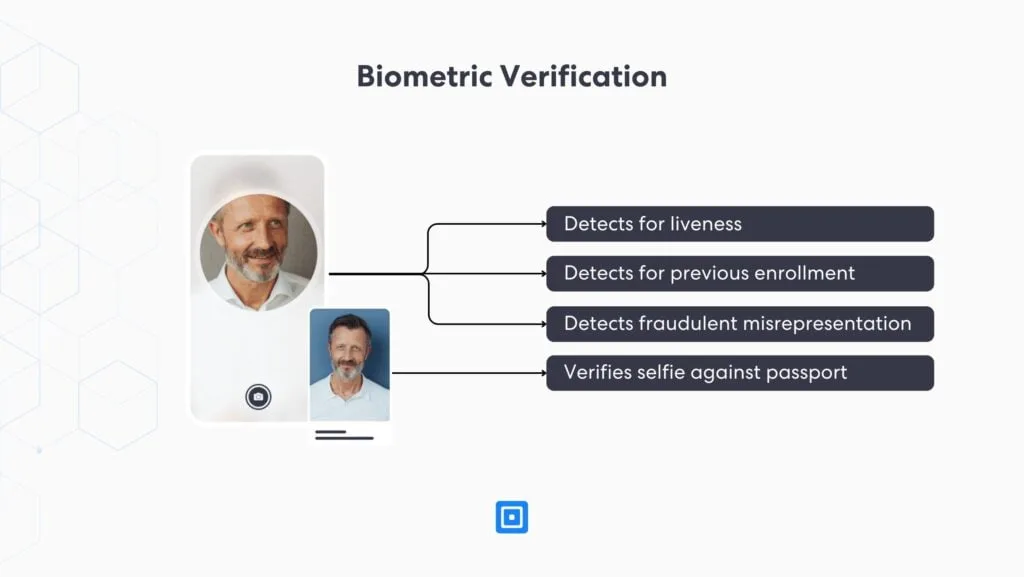

Vérification biométrique

Vérification biométrique utilise de puissantes technologies d'identification biométrique et de reconnaissance faciale pour scanner, vérifier et authentifier les données biométriques des utilisateurs. En analysant les informations biométriques, telles que les traits du visage, les micro-expressions, les tons de peau et la texture (parfois à l'aide de données alternatives telles que les scans d'iris), ce processus agit comme un outil de détection de vivacité et empêche les attaques de présentation, telles que les deepfakes.

L'authentification et la vérification biométriques sont les méthodes les plus sûres pour vérifier l'identité d'une personne et sont indispensables pour détecter les deepfakes. Les données biométriques sont les plus difficiles à falsifier, même avec l'IA ; cependant, cela ne signifie pas que les deepfakes sont faciles à détecter.

Les solutions d'identification automatisées sont un élément essentiel des processus modernes de vérification d'identité, d'acquisition de clients et d'authentification en raison du volume considérable de contrôles qui doivent être effectués avec précision et à grande échelle. Pour plus d'informations, lisez Les avantages de la vérification biométrique.

Les deepfakes et l'intégrité des élections

Les deepfakes peuvent nuire aux élections en diffusant de fausses informations et en manipulant l’opinion publique. Au Royaume-Uni, une étude récente de l’Institut Alan Turing a révélé que près de neuf personnes sur dix craignent que les deepfakes n’influencent les résultats des élections (Institut Alan Turing).

9 personnes sur 10 préoccupées par les deepfakes affectant les résultats des élections.

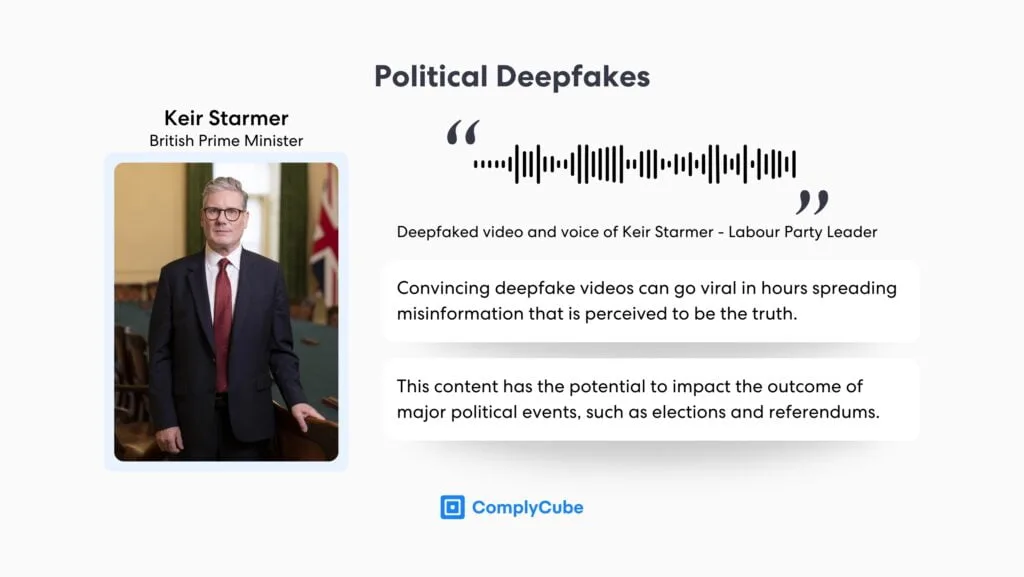

Cette inquiétude n’est pas sans fondement. Des cas très médiatisés de deepfakes ciblant des personnalités politiques, tels que des clips audio et vidéo fabriqués de toutes pièces de dirigeants importants, ont déjà fait surface, avec le risque de semer la discorde et la confusion parmi les électeurs.

Par exemple, à l’approche des élections générales britanniques de 2024, des deepfakes imitant les voix du Premier ministre de l’époque, Rishi Sunak, du leader travailliste Keir Starmer et du maire de Londres Sadiq Khan ont été diffusés sur les réseaux sociaux, touchant des centaines de milliers de téléspectateurs et créant des idées fausses.

Ces manipulations vont de faux scandales de corruption à des déclarations trompeuses sur des positions et intentions politiques. De tels contenus peuvent être extrêmement préjudiciables, surtout lorsque les électeurs ne savent pas faire la différence entre le vrai et le faux.

Détection et réponse aux deepfakes

Détecter les deepfakes est de plus en plus difficile, même pour les géants de la technologie comme Meta, Google et Microsoft, qui se sont engagés à lutter contre l’IA trompeuse lors des élections. Le principal problème réside dans la sophistication des outils d’IA qui peuvent créer des contenus impossibles à distinguer de la réalité.

Par exemple, le président des affaires mondiales de Meta, Nick Clegg, a souligné les défis liés à l’identification du contenu généré par l’IA, soulignant que les acteurs malveillants peuvent supprimer les marqueurs invisibles qui indiquent généralement une manipulation.

La menace des deepfakes est mondiale et semble suivre les événements internationaux. En Amérique, les deepfakes imitent La voix du président Joe Biden a été utilisée dans un appel automatisé pour partager de fausses informations sur l'élection. Cet incident met en évidence le potentiel des deepfakes à réduire la participation électorale en diffusant des informations trompeuses.

Le problème ne se limite pas à l'identification des deepfakes. La propagation rapide des contenus frauduleux signifie qu'une fois qu'un deepfake devient viral, il est probable que le mal soit fait avant que l'image ou la vidéo ne soit démystifiée.

Cela nécessite d'agir sur le contenu frauduleux avant qu'il ne puisse être téléchargé. Les plateformes de médias sociaux telles que Twitter (désormais X), Facebook, Instagram et bien d'autres doivent utiliser des défenses robustes basées sur l'IA pour reconnaître les médias frauduleux avant qu'ils ne puissent être publiés. Une telle action pourrait être effectuée via de puissants SDK et API de détection d'activité. Pour plus d'informations, lisez Intégration avec un SDK de détection de vivacité.

Détection de deepfakes dans la vérification d'identité

Les deepfakes ont infiltré bien plus de secteurs que les réseaux sociaux. Ils sont devenus un problème majeur dans les méthodes de vérification et d'authentification d'identité pour de nombreux secteurs financiers, notamment les applications bancaires traditionnelles, les applications de trading et de crypto-monnaie et les services de paiement. Les attaques deepfakes sont utilisées chaque jour pour commettre des fraudes, vider des comptes et même ouvrir de nouveaux comptes, par exemple auprès d'entreprises de crédit.

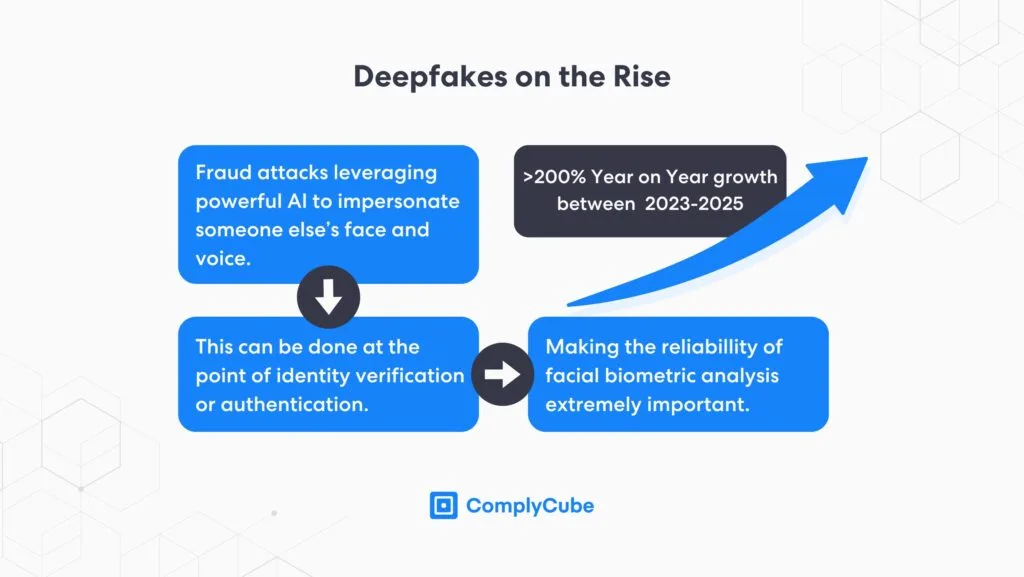

L’IA générative représente la plus grande menace pour le secteur [financier], ce qui pourrait potentiellement permettre aux pertes dues à la fraude d'atteindre 16,4 milliards de dollars américains d'ici 2027, contre 12,3 milliards de dollars en 2023.

Cette prédiction suggère alors que la fraude deepfake pourrait augmenter de plus de 200% sur une période de 4 ans, devenant ainsi l'un des principaux contributeurs à la fraude financière mondiale.

L'érosion de la confiance due à la technologie frauduleuse

Au-delà des élections, la prolifération des deepfakes constitue une menace plus large pour la confiance du public et du privé dans l’information et l’identité. À mesure que la technologie des deepfakes se répand, les gens deviennent de plus en plus sceptiques à l’égard des médias qu’ils consomment. Ce scepticisme des médias pourrait conduire à un phénomène connu sous le nom de dividende du menteur, où la possibilité d’un faux contenu donne aux individus un déni plausible, compromettant ainsi la responsabilité et la vérité.

Un exemple courant de ce phénomène est la couverture médiatique négative d’une personnalité publique, d’un dirigeant politique ou d’un chef d’entreprise. Le scepticisme à l’égard des médias authentiques permet à ces individus de jouer sur ce sentiment public et de l’utiliser à leur avantage pour prétendre qu’il n’est pas authentique. Il est facile de comprendre comment cet effet pourrait se produire.

Instaurer la confiance à grande échelle grâce à un logiciel de détection de deepfakes

Si les dangers des deepfakes sont évidents, des mesures réglementaires efficaces sont encore en cours d’élaboration. Bien qu’il n’existe pas de mesures réglementaires à l’échelle nationale aux États-Unis, au moins 20 États ont promulgué des lois contre les deepfakes électoraux, une stratégie fédérale cohérente reste difficile à mettre en place. Le ministère du Trésor s’est toutefois engagé à soutenir les technologies automatisées. comme les meilleures mesures pour prévenir et contrer les nouvelles méthodes frauduleuses.

Le Royaume-Uni a également connu des progrès limités. Bien qu’il existe des lois contre la création et la diffusion de contenus deepfakes préjudiciables à la personne, tels que les deepfakes explicites, des réglementations plus larges concernant la création et l’utilisation de deepfakes à des fins de manipulation électorale n’ont pas encore été adoptées.

Pour l’heure, il appartient à l’entreprise concernée d’adopter des solutions IDV robustes pour contrer le mouvement frauduleux deepfake. Les entreprises doivent inclure la possibilité d’une fraude deepfake dans leur approche basée sur les risques (RBA) lorsqu’elles envisagent une stratégie AML adaptée.

À propos de ComplyCube

Pour lutter contre la menace croissante de la fraude par IA, les technologies de détection des deepfakes et les solutions d'identification des fraudes sont désormais essentielles. Ces technologies utilisent l'IA de génération pour analyser des ensembles de données similaires à ceux utilisés pour créer des deepfakes afin d'identifier les faux contenus et de limiter la fraude.

La vérification des documents et la vérification biométrique de ComplyCube sont deux méthodes clés utilisées dans IDV pour vérifier et authentifier les identités en détectant le contenu deepfake et sont utilisées par des centaines d'entreprises technologiques à travers le monde.

Le principal fournisseur de solutions d'identification des identités a été créé pour lutter contre les menaces croissantes des méthodologies frauduleuses innovantes au 21e siècle. En s'appuyant sur des algorithmes avancés d'IA et d'apprentissage automatique, la plateforme de ComplyCube offre des services complets de vérification d'identité et biométrique, garantissant une protection robuste contre la fraude à l'identité et les contenus deepfake.

Bénéficiant d'une solution flexible et personnalisable, leurs services peuvent être adaptés en fonction de la RBA d'une entreprise pour aider les entreprises à améliorer leurs protocoles de sécurité, à maintenir la conformité aux normes réglementaires et à instaurer la confiance avec leurs clients dans un monde de plus en plus numérique. Pour plus d'informations, Contactez un spécialiste de la conformité dès aujourd'hui.