La politica globale è incentrata su narrazioni mutevoli che vengono riscritte da milioni di persone ogni giorno, poiché le nostre opinioni vengono rimodellate dall'ultima cosa che leggiamo su Twitter. Quando ciò che leggiamo sono le opinioni di persone reali di ogni estrazione sociale, allora stiamo sicuramente raccogliendo i frutti della libertà di parola, un uso chiaramente democratico della tecnologia. Tuttavia, quando ciò che leggiamo è la conseguenza di una mancanza di controlli di identità necessari e di bot fraudolenti sui social media, è tutt'altro che democratico: è un tentativo di controllare uno spazio che dovrebbe essere nostro. La mancanza di pratiche di verifica dei social media sulle piattaforme online ha consentito ai malintenzionati di orientare le discussioni globali, spesso diffondendo false informazioni per raggiungere un'agenda politica specifica. L'implementazione del rilevamento di account falsi sui social media è, quindi, diventata critica.

Gli account falsi e i bot sono stati strettamente legati alla politica internazionale per molto tempo, causando controversie in tutto il mondo negli ultimi dieci anni. Centinaia, se non migliaia, di articoli di notizie hanno segnalato un'attività di bot aumentata sulle piattaforme social prima delle elezioni. In vista delle elezioni del Regno Unito del 2024, articoli come l'articolo di Global Witness, "L'indagine rivela che i contenuti pubblicati da account simili a bot su X sono stati visti 150 milioni di volte prima delle elezioni del Regno Unito”, ha evidenziato come le opinioni del pubblico in generale non sarebbero state l’unico fattore decisivo.

È interessante notare che non sono solo le piattaforme mediatiche ad aver parlato del traffico politico guidato dai bot, ma anche gli accademici hanno preso in mano la questione negli ultimi 20 anni. Nelle prime discussioni sul software bot dannoso, T. Holz ha scritto un articolo critico nel 2005, "Una breve visita allo zoo dei bot". Questo è stato uno dei primi articoli ad affrontare gli attacchi bot online, che all'epoca erano usati principalmente per furti di identità di massa, attacchi DDoS (distributed denial-of-service) o invio di spam.

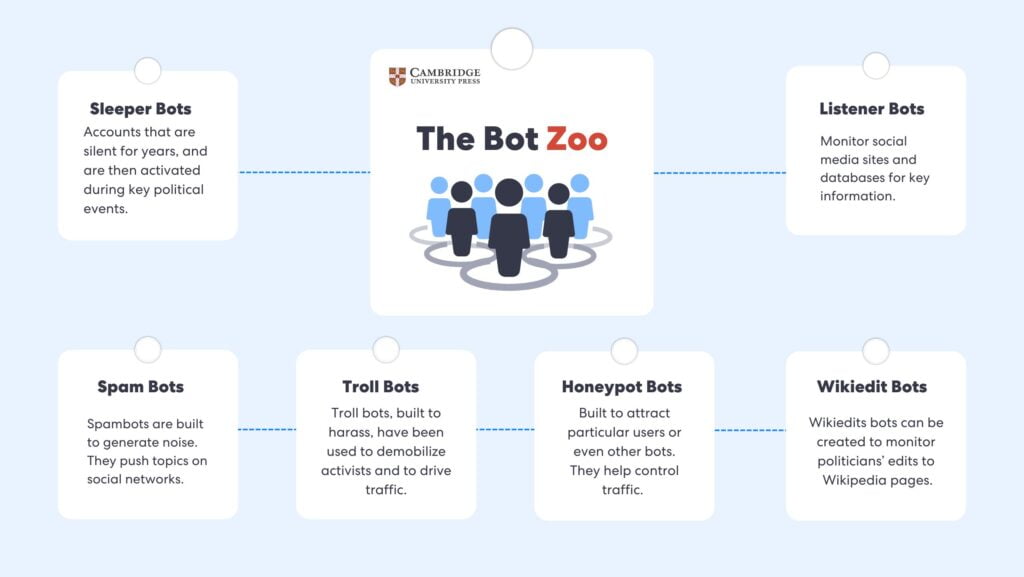

Holz è riuscito a catturare le caratteristiche chiave di questi bot, delineandone i tratti e i comportamenti. Ha anche creato una struttura che potrebbe categorizzare diversi tipi di bot. Gli accademici di Cambridge hanno preso il lavoro di Holz nel 2020, così come molti altri importanti articoli e studi sul comportamento dei bot dal 2005, e hanno creato in modo simile la loro classificazione, concentrandosi specificamente sull'attività online dei bot politici.

Uno zoo di bot politici

Gli accademici della Cambridge University Press hanno scritto ampiamente sull'uso e le minacce dei bot politici. Samuel C. Woolley è riuscito a fare passi da gigante nel suo articolo del 2020, "Bots and Computational Propaganda: Automazione per la Comunicazione e il Controllo.” Afferma in questo articolo che “La presenza [di] bot sociali nella discussione politica online può creare tre problemi tangibili: in primo luogo, l’influenza può essere ridistribuita tra account sospetti che possono essere gestiti con scopi dannosi; in secondo luogo, la conversazione politica può diventare ulteriormente polarizzata; in terzo luogo, la diffusione di disinformazione e informazioni non verificate può essere aumentata.”

Continua a replicare la classificazione originale Bot-Zoo di Holz ma applica il concetto a bot politici, individuando le seguenti categorie:

- Bot ascoltatori: Possono monitorare i siti e i database dei social media per reperire informazioni chiave, ma anche tracciare e comunicare ciò che trovano.

- Spambot: Gli spambot, al contrario, sono concepiti per generare rumore.

- Bot di Wikiedit: È possibile creare bot Wikiedit per monitorare le modifiche apportate dai politici alle pagine di Wikipedia.

- Robot dormienti: I bot dormienti sono account di social media che risiedono su un sito come Twitter, praticamente inutilizzati da anni, per generare una presenza online più realistica. Vengono poi attivati durante eventi politici chiave.

- Troll bot: I troll bot, creati per molestare, sono stati utilizzati per trollare gli attivisti che cercavano di organizzarsi e comunicare su Twitter, ma possono anche indirizzare il traffico da una causa, un prodotto o un'idea a un'altra.

- Bot honeypot: Creato per attrarre utenti specifici o addirittura altri bot.

Politica moderna

La politica moderna è diventata sempre più intrecciata con le piattaforme dei social media, dove la battaglia per l'opinione pubblica è spesso influenzata da attori malintenzionati piuttosto che da un discorso autentico. La proliferazione di bot e account falsi ha spostato il panorama dell'impegno politico, consentendo alla disinformazione di diffondersi a velocità senza precedenti.

L'incidente del pallone spia cinese (2024)

Un esempio di questo è un caso che ha avuto luogo all'inizio del 2024, in cui eserciti di bot si sono scontrati sui social media per l'incidente del pallone spia cinese. I ricercatori della Carnegie Mellon University hanno esaminato 1,2 milioni di tweet relativi all'incidente, trovando alcuni risultati interessanti.

I tweet cinesi erano principalmente artificiali, con 64% dei tweet scritti da bot. Tuttavia, anche gli Stati Uniti hanno utilizzato i bot per cercare di spostare la colpa, con 35% dei loro tweet provenienti da bot. Questo caso evidenzia che gran parte del contenuto che incontriamo quotidianamente su piattaforme come Twitter o Facebook potrebbe non essere affidabile, poiché sta diventando sempre più difficile distinguere tra informazioni reali e inventate.

Referendum sulla Brexit (2016)

Il dott. Marco Bastos ha scoperto una rete di bot dei social media che sono stati utilizzati per saturare Twitter con messaggi elettorali durante la campagna del referendum sulla Brexit del 2016. La ricerca ha scoperto che 13.493 account hanno twittato nelle due settimane prima e dopo il referendum.

Queste false identità online hanno espresso opinioni e hanno tentato di manipolare l'opinione pubblica attraverso rapidi tweet a cascata.

Non sorprende che questi profili siano scomparsi dopo la fine delle votazioni. La ricerca della City University su questo caso afferma che "queste false identità online hanno espresso opinioni e hanno tentato di manipolare l'opinione pubblica attraverso rapidi tweet a cascata".

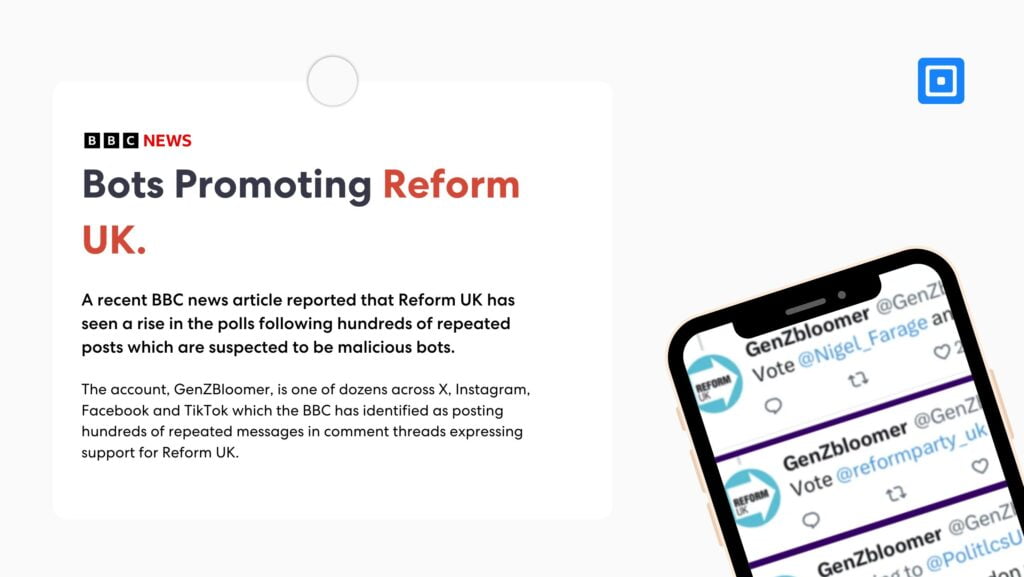

Bot che promuovono la riforma nel Regno Unito (2024)

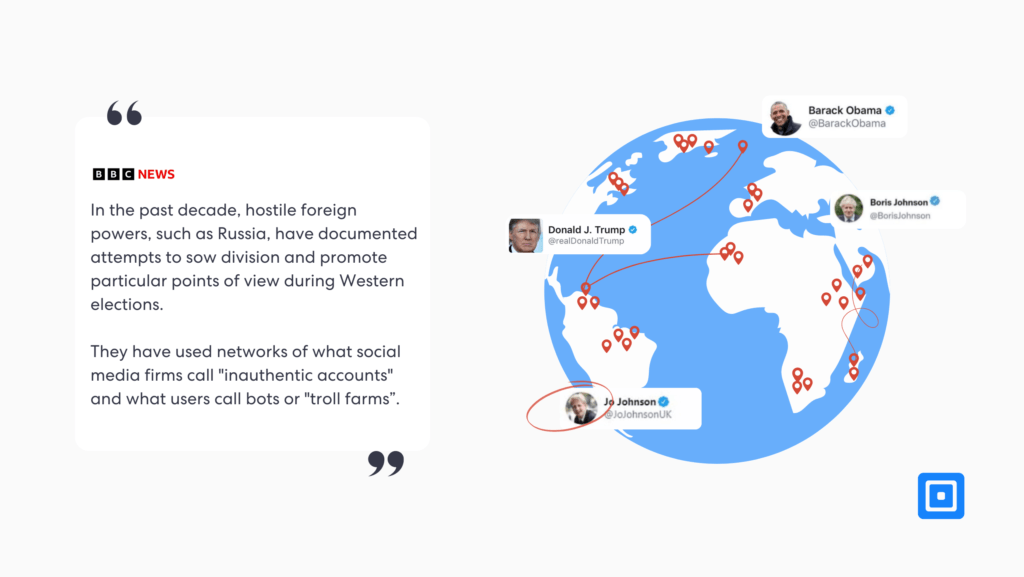

Un recente Articolo di notizie della BBC ha riferito che Reform UK ha visto un aumento nei sondaggi a seguito di post ripetuti che si sospetta siano stati progettati da bot malevoli. La BBC ha deciso di indagare ulteriormente, contattando le persone dietro gli account che cercano chiaramente di esagerare la popolarità di Reform UK. A seguito di preoccupazioni circa l'interferenza straniera in altre elezioni, l'indagine ha concluso che molti di questi account erano non autentici.

L'articolo della BBC afferma: "Nell'ultimo decennio, potenze straniere ostili, come la Russia, hanno documentato tentativi di seminare divisione e promuovere particolari punti di vista durante le elezioni occidentali. Hanno utilizzato reti di ciò che le aziende di social media chiamano 'account non autentici' e ciò che gli utenti chiamano bot o 'troll farm'".

I ricercatori hanno catalogato l'uso dei bot politici nel rafforzare massicciamente le metriche dei social media di politici e candidati politici da Donald Trump a Rodrigo Duterte.

È difficile identificare la portata dell'influenza ottenuta da queste forme di manipolazione, eppure molti giornalisti e accademici sono giunti alla conclusione che è certamente significativa. Gli accademici della Cambridge University Press riferiscono che "i ricercatori hanno catalogato l'uso di bot politici nel rafforzare massicciamente le metriche dei social media di politici e candidati politici da Donald Trump a Rodrigo Duterte."

Prendere il controllo della situazione

Ciò che bisogna considerare è se le piattaforme online stanno facendo abbastanza per frenare la diffusione di contenuti dannosi guidati da bot. In particolare, i periodi elettorali sembrano innescare un aumento di tale attività, indicando una mancanza di sistemi di verifica dell'identità robusti.

Molte piattaforme di social media sembrano provare a risolvere il problema rimuovendo account falsi. Nell'ultimo trimestre del 2023, Facebook ha rimosso quasi 700 milioni di account falsi sui social media dopo averne rimossi 827 milioni nel trimestre precedente. Tuttavia, non importa quanti utenti sospetti vengano rimossi, sicuramente ne ricompaiono altri. Il problema risiede chiaramente nel processo di registrazione.

Misure più severe, come la verifica dell'identità, potrebbero aiutare a ridurre drasticamente il numero di questi account fraudolenti. In definitiva, garantire l'integrità delle discussioni politiche online richiederà uno sforzo collaborativo tra governi, aziende tecnologiche e utenti stessi.

I prossimi passi per piattaforme più sicure

Il software di verifica dell'identità (IDV) fornisce una soluzione sicura per combattere il traffico online guidato da bot, applicando rigidi protocolli di autenticazione utente e verifica dell'identità. Queste piattaforme possono implementare diverse misure chiave:

Controlli dei documenti: Questi controlli verificano che l'identità presentata sia autentica e valida, esaminando documenti ufficiali come i passaporti per confermarne la legittimità.

Verifica biometrica: I controlli biometrici vanno oltre, analizzando le sottili microespressioni facciali per garantire che la persona che presenta il documento sia il legittimo proprietario. La tecnologia di rilevamento della vitalità verifica anche che l'utente sia fisicamente presente e non un bot o una registrazione.

Verifica dell'età: La salvaguardia dei minori è fondamentale per creare ambienti online più sicuri. La verifica dell'età aiuta a garantire che gli utenti soddisfino i requisiti di età, riducendo il rischio di sfruttamento o esposizione a contenuti dannosi.

Integrando queste tecniche, le piattaforme IDV possono ridurre significativamente l'attività dei bot, salvaguardando gli spazi dei social media da un uso improprio. Queste misure assicurano che solo gli utenti reali creino account, frenando la diffusione di spam, disinformazione e altre attività dannose.

Per maggiori informazioni su come proteggere la tua piattaforma online dalle frodi tramite bot, contatta il nostro team di esperti in materia di conformità.