Il 2024 ha visto un picco globale di frodi digitali, con aziende e privati che si trovano ad affrontare una minaccia in continua evoluzione che ha iniziato a crescere a dismisura. L'intelligenza artificiale ha dato ai truffatori il potere di creare false identità altamente ingannevoli, sfruttando tecnologie come i deepfake per commettere sofisticati attacchi di presentazione durante i processi di onboarding dei clienti, con conseguenze finanziarie spesso gravi. Con il 2025 all'orizzonte, a quali tipi di crimini digitali devono prepararsi le aziende e cosa possono fare per rafforzare le proprie difese?

Diverse forme chiave di criminalità digitale domineranno i tentativi di frode nel prossimo anno, tra cui deepfake sempre più sofisticati, frodi sui social media, attacchi di phishing guidati da AI generativa, identità compromesse e altro ancora. Inoltre, poiché tecnologie come l'AI generativa diventano più semplici da usare, il numero di malintenzionati continua ad aumentare. La barriera all'ingresso in termini di commissione di attacchi fraudolenti si è notevolmente abbassata, con strumenti come DeepFakeLab pubblicamente disponibili per chiunque voglia creare un deepfake scelto.

Attacchi di presentazione sofisticati: Deepfake

Gli attacchi Deepfake non sono più un evento raro, con diversi strumenti disponibili online che chiunque può utilizzare per crearne uno. La loro prevalenza online è aumentata drasticamente negli ultimi anni, con una Deloitte che segnala un 700% aumento di incidenti deepfake nel settore fintech solo nel 2023.

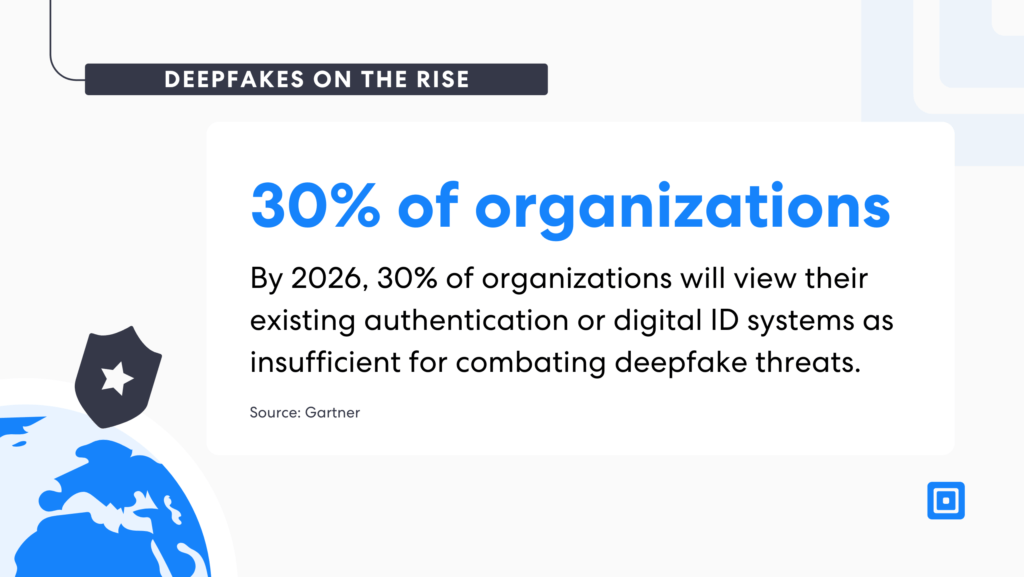

Entro il 2026, 30% delle organizzazioni considereranno i loro attuali sistemi di autenticazione o di identificazione digitale insufficienti per contrastare le minacce deepfake.

Un rapporto Ofcom del 2024 ha rivelato che 60% di persone nel Regno Unito si sono imbattuti in almeno un deepfake. Inoltre, Gartner prevede che entro il 2026, 30% delle organizzazioni considereranno i loro attuali sistemi di autenticazione o di identificazione digitale insufficienti per contrastare le minacce deepfake.

Akif Khan, VP Analyst presso Gartner, afferma: "Nell'ultimo decennio, si sono verificati diversi punti di svolta nei campi dell'intelligenza artificiale che consentono la creazione di immagini sintetiche. Queste immagini generate artificialmente di volti di persone reali, note come deepfake, possono essere utilizzate da attori malintenzionati per minare l'autenticazione biometrica o renderla inefficiente. Di conseguenza, le organizzazioni potrebbero iniziare a mettere in discussione l'affidabilità delle soluzioni di verifica e autenticazione dell'identità, poiché non saranno in grado di dire se il volto della persona che viene verificata è un persona reale o un deepfake."

Gli esseri umani spesso non sono in grado di distinguere un deepfake da una persona in carne e ossa, motivo per cui le organizzazioni devono iniziare a investire massicciamente in software all'avanguardia per il rilevamento della vitalità. Tecnologie di rilevamento della vitalità può identificare i deepfake analizzando la consistenza della pelle, le sottili microespressioni e altri dettagli non rilevabili dall'occhio umano o dai semplici processi di verifica dell'identità.

Le piattaforme dei social media come nuovo parco giochi per la criminalità informatica

Oltre a semplificare le pratiche di verifica dell'identità, lo schema eID getta anche le basi per un rapido e digitale È già risaputo che le piattaforme dei social media sono il luogo in cui hanno inizio molti crimini moderni, con Facebook che ha ammesso di aver rimosso 700 milioni di account falsi sui social media nel quarto trimestre del 2023, dopo averne rimossi 827 milioni nel trimestre precedente. Indubbiamente, nel 2025, questa tendenza continuerà poiché il numero di utenti dei social media continua ad aumentare.

Gli strumenti di intelligenza artificiale generativa consentiranno inoltre ai truffatori di eseguire attacchi di impersonificazione a uno standard più elevato, esponendo gli utenti dei social media a un rischio maggiore di diventare vittime di pratiche come il catfishing e le truffe del macello di maiali. Modelli linguistici avanzati come Chat GPT possono generare testo che imita lo stile di scrittura di qualcuno, consentendo ai truffatori di impersonare un individuo tramite messaggi o post. Allo stesso modo, l'intelligenza artificiale può essere utilizzata per creare automaticamente un gran numero di account falsi sulle piattaforme dei social media, utilizzando profili con nomi, immagini e sfondi realistici.

Quasi 80% di truffe inizia online.

Un portavoce di Lloyds ha recentemente parlato al Sunday Times, affermando che "Quasi l'80% delle truffe inizia online e da tempo chiediamo alle aziende di social media e tecnologiche di fare di più per proteggere i propri utenti e aiutare a risarcire le vittime innocenti."

Finora, non abbiamo visto le piattaforme di social media implementare completamente i necessari controlli di sicurezza, poiché non potrebbe essere più semplice creare un account Instagram o Facebook con una falsa identità. Tuttavia, se queste piattaforme implementassero processi di registrazione più rigidi con la prova di identità come requisito, i casi di frode diminuirebbero.

Attacchi di phishing a supporto dell'intelligenza artificiale generativa

Le minacce di phishing potenziate dall'intelligenza artificiale assumono molte forme, dalle e-mail generate con grammatica impeccabile e inclusione di dati personali a malware altamente adattabili in grado di apprendere ed eludere i sistemi di rilevamento. Questa prossima generazione di attacchi di phishing sfrutterà la capacità dell'intelligenza artificiale di apprendere dai dati in tempo reale, adattandosi in risposta alle misure di sicurezza in evoluzione, rendendo così il rilevamento ancora più impegnativo.

Oltre all'aumento della qualità degli attacchi di phishing, anche la quantità di questi attacchi è destinata ad aumentare con l'aiuto dell'intelligenza artificiale generativa. L'intelligenza artificiale generativa consentirà di eseguire simultaneamente migliaia di attacchi di phishing mirati, senza compromettere la personalizzazione mirata per il massimo effetto. Le operazioni su larga scala saranno eseguite da truffatori, con probabilità di successo molto più elevate. Inoltre, poiché commettere frodi diventa più facile con l'aiuto dell'intelligenza artificiale e sono necessarie meno competenze tecniche, inizieranno a emergere più truffatori.

La ricerca che abbiamo pubblicato all'inizio di quest'anno ha mostrato che il 60% dei partecipanti è caduto vittima del phishing automatizzato dall'intelligenza artificiale (IA), che è paragonabile ai tassi di successo dei messaggi di phishing non AI creati da esperti umani. ~ Harvard Business Review

Harvard Business Review ha pubblicato una ricerca all'inizio del 2024 che ha evidenziato il tasso di successo molto più elevato delle e-mail di phishing potenziate dall'intelligenza artificiale, con 60% di partecipanti vittime di queste truffe. Affermano: "Forse ancora più preoccupante, la nostra nuova ricerca dimostra che l'intero processo di phishing può essere automatizzato utilizzando LLM, il che riduce i costi degli attacchi di phishing più di 95% ottenendo tassi di successo uguali o maggiori". Ciò suggerisce che gli attacchi di phishing non miglioreranno solo in termini di qualità, ma anche di quantità, con una vasta quantità di attacchi effettuati in tutto il mondo in tutti i settori.

Attacchi alle catene di fornitura:

Con l'avvicinarsi del 2025, si prevede che gli attacchi alla supply chain diventeranno più sofisticati, con i criminali informatici che prendono di mira i fornitori più piccoli e meno sicuri per ottenere l'accesso alle organizzazioni più grandi. Questi attacchi possono riguardare frodi basate sull'intelligenza artificiale, ransomware, esfiltrazione di dati e persino l'interruzione di infrastrutture critiche. Il National Cyber Security Centre nel Regno Unito afferma: "Negli ultimi anni c'è stato un aumento significativo del numero di attacchi informatici derivanti da vulnerabilità all'interno della catena di fornituraQuesti attacchi possono avere conseguenze devastanti, costose e a lungo termine per le organizzazioni interessate, le loro catene di fornitura e i loro clienti".

Principali tendenze negli attacchi alla supply chain:

- Attacchi basati sull'intelligenza artificiale:I truffatori utilizzeranno strumenti di intelligenza artificiale per creare comunicazioni false, phishing e deepfake, rendendo più difficile il rilevamento.

- Puntare ai venditori più piccoli:I criminali informatici sfrutteranno gli anelli più deboli della catena di fornitura per infiltrarsi nelle organizzazioni più grandi.

- Ransomware e furto di dati:Gli aggressori possono tenere in ostaggio i sistemi o rubare dati sensibili per chiedere un riscatto.

- Interruzione delle infrastrutture critiche:Gli attacchi alla supply chain possono colpire settori come quello energetico o sanitario, provocando danni estesi.

Rafforzare le operazioni con un KYC robusto

I processi KYC (Know Your Customer) possono essere fondamentali per mitigare molte delle nuove minacce di frode digitale che le aziende dovranno affrontare nel 2025, come deepfake, frodi sui social media, phishing basato sull'intelligenza artificiale e attacchi alla supply chain.

Combattere i Deepfake: KYC può rafforzare la verifica dell'identità assicurando che gli individui sottoposti a onboarding siano chi dichiarano di essere. Integrando rilevamento della vivacità con KYC, le aziende possono prevenire le frodi basate su deepfake durante la creazione di account o le transazioni finanziarie, rendendo più difficile per i truffatori impersonare clienti legittimi. Per maggiori informazioni sull'aumento dei deepfake, leggi "Software di rilevamento deepfake: prevenzione dei contenuti fraudolenti.“

Prevenire il phishing basato sull'intelligenza artificiale: I dati KYC aiutano a garantire che le comunicazioni (e-mail, messaggi, ecc.) che coinvolgono azioni sensibili, come bonifici bancari o modifiche di account, siano autenticate. Verificando l'identità dell'individuo dietro ogni richiesta, le aziende possono identificare meglio i tentativi di phishing generati dall'intelligenza artificiale, che si basano sull'imitazione dei modelli di comunicazione umana.

Proteggere la catena di fornitura: KYC può essere utilizzato per verificare la legittimità di venditori e fornitori terzi, assicurando che non siano collegati ad attività fraudolente o criminali. Eseguendo una due diligence approfondita su tutti i fornitori, le aziende possono ridurre il rischio di attacchi alla supply chain che sfruttano i collegamenti più deboli per infiltrarsi in organizzazioni più grandi.

Per maggiori informazioni su come rafforzare le tue operazioni con un'infrastruttura KYC all'avanguardia, contatta uno dei consulenti ComplyCube esperti di conformità Oggi.