L'aumento delle frodi deepfake ha introdotto una nuova dimensione di rischio per le aziende, erodendo le fondamenta della fiducia digitale. Queste manipolazioni generate dall'intelligenza artificiale, in grado di imitare discorsi, espressioni facciali e gesti con sorprendente precisione, non sono più limitate a esperti qualificati. Gli strumenti open source hanno democratizzato la creazione di deepfake, consentendo anche a coloro con competenze tecniche minime di produrre video e immagini falsi convincenti, amplificando la loro minaccia sulle piattaforme dei social media. Per le aziende, le conseguenze degli attacchi deepfake sono di vasta portata, dalle frodi finanziarie e violazioni dei dati ai danni alla reputazione e alla perdita di fiducia degli stakeholder. Con l'evoluzione di queste minacce, gli strumenti di rilevamento deepfake sono diventati indispensabili. Questa guida esamina in che modo tali strumenti aiutano le aziende a proteggere le operazioni, garantire la fiducia degli stakeholder, condurre valutazioni complete e rimanere resilienti contro le minacce emergenti.

Cosa sono i Deepfake?

I deepfake sono video, immagini o registrazioni audio creati o alterati artificialmente, progettati per apparire e suonare completamente reali. Sono generati utilizzando tecniche avanzate di intelligenza artificiale (IA), consentendo ai truffatori di manipolare l'aspetto, la voce o persino il comportamento di una persona nei contenuti digitali. A differenza delle semplici immagini generate dall'IA e manipolate in modo innocente, i deepfake possono creare identità completamente nuove e falsificare scenari del mondo reale sostituendo il volto o la voce di una persona con quelli di un'altra.

Ciò che rende i deepfake particolarmente pericolosi è la loro connessione con frode di identità sinteticaIn questi schemi, i truffatori mescolano informazioni vere e false, ad esempio combinando un vero numero di previdenza sociale con dati personali inventati o un nome falso, per creare una falsa identità. Questo profilo sintetico può quindi essere utilizzato per aggirare i controlli di sicurezza, aprire conti falsi o commettere reati finanziari, rendendo il rilevamento dei deepfake estremamente difficile senza strumenti specializzati.

46% delle organizzazioni nel 2022 si sono verificate frodi di identità sintetica a livello mondiale.

Nel 2022, ben il 46% delle organizzazioni in tutto il mondo ha dovuto affrontare frodi di identità sintetica e questo numero continua a crescere, costando alle aziende cifre esorbitanti e compromettendo informazioni sensibili di vittime ignare.

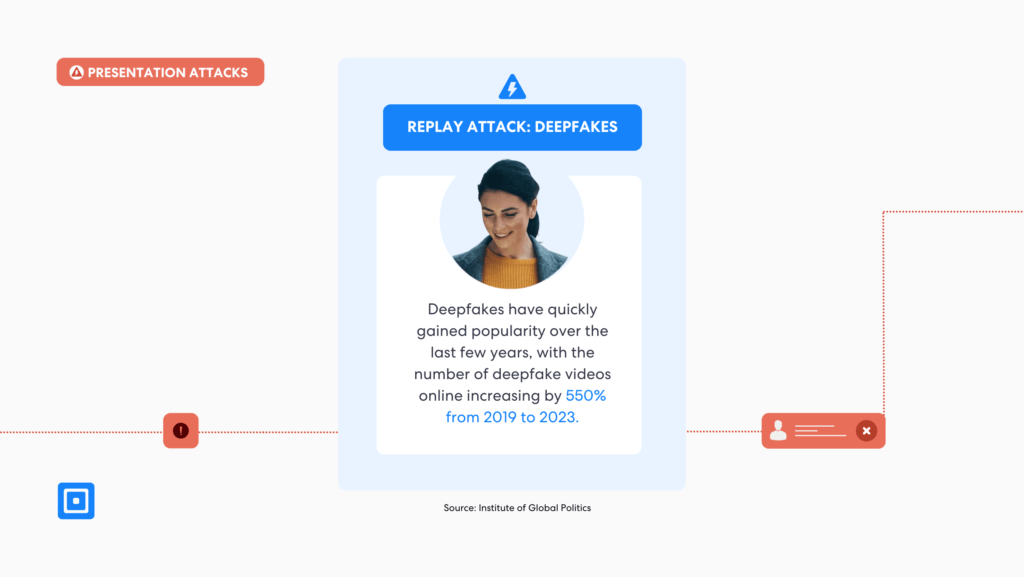

Dalle transazioni finanziarie fraudolente al sabotaggio reputazionale, i deepfake si sono evoluti in un potente strumento per i cattivi attori malintenzionati. Come notato da Istituto Buffett della Northwestern per gli affari globali, “In un mondo pieno di disinformazione e sfiducia, l'intelligenza artificiale fornisce mezzi sempre più sofisticati per convincere le persone della veridicità di informazioni false che hanno il potenziale di portare a una maggiore tensione politica, violenza o persino guerra". Questa realtà che fa riflettere rivela non solo la nuova minaccia della minaccia tecnica posta dai deepfake, ma il loro più ampio impatto sociale.

Manipolazione Deepfake sulle piattaforme dei social media

La qualità iperrealistica dei deepfake spesso inganna gli spettatori e sfugge ai metodi di rilevamento tradizionali. Man mano che queste manipolazioni diventano più convincenti, sono necessarie tecnologie avanzate per identificare i marcatori sottili dei video e dei contenuti deepfake.

L'impiego dell'intelligenza artificiale e dell'apprendimento automatico nella creazione di deepfake

In sostanza, i deepfake vengono creati utilizzando tecniche avanzate e approfondite di apprendimento automatico, principalmente reti generative avversarie (GAN) e reti neurali. Questi sistemi sono progettati per replicare e manipolare caratteristiche, espressioni e discorsi umani con una precisione notevole. Per semplificare, una GAN funziona come una competizione continua tra due sistemi di intelligenza artificiale (IA): il generatore e il discriminatore.

Il generatore agisce come un artista altamente qualificato, utilizzando metodi di apprendimento automatico per creare immagini, video o audio falsi. Lo fa analizzando enormi set di dati pieni di esempi di tratti del viso, modelli vocali e movimenti delle labbra del mondo reale. Ad esempio, studia come si muovono le bocche quando vengono pronunciate determinate parole, come appare la consistenza della pelle in diverse condizioni di illuminazione e come i muscoli facciali si spostano durante le espressioni. Nel tempo, il generatore impara a imitare questi dettagli con una precisione crescente.

Il discriminatore, d'altro canto, funge da critico meticoloso. Valuta il contenuto creato dal generatore, analizzando ogni dettaglio, fino alle sottili incongruenze nei movimenti delle labbra, nelle transizioni del tono della pelle o nei riflessi degli occhi, per determinare se l'output è autentico o sintetico. Il compito del discriminatore è quello di segnalare qualsiasi cosa sembri fuori posto.

Il generatore continua a perfezionare il suo lavoro in base al feedback che riceve dal discriminatore. Nel tempo, questo processo avanti e indietro migliora la capacità del generatore di produrre contenuti così convincenti che persino il discriminatore fa fatica a capire se si tratta di contenuti falsi. Questo ciclo continuo è ciò che rende i deepfake sempre più realistici e difficili da rilevare senza strumenti specializzati.

Tecniche di scambio di volti e implicazioni per il rilevamento dei deepfake

Uno degli usi più riconoscibili della tecnologia deepfake è lo scambio di volti, in cui il volto di una persona viene sovrapposto a quello di un'altra in un contenuto video. Queste manipolazioni possono far sembrare che qualcuno abbia detto o fatto cose che in realtà non ha mai fatto, rendendole uno strumento potente per le campagne di disinformazione. Tuttavia, le implicazioni vanno ben oltre la disinformazione.

Questa nuova tecnologia ha anche dato origine al deepfake phishing, una forma particolarmente insidiosa di cybercrimine. Secondo Stu Sjouwerman, esperto del settore e collaboratore di Forbes sulla sicurezza di Internet, "È noto che i phisher evolvono le loro tattiche in linea con l'evoluzione della tecnologia. Negli ultimi anni, il phishing ha cambiato di nuovo forma, utilizzando una tecnologia che alcuni esperti definiscono la forma più pericolosa di cybercrimine alimentato dall'intelligenza artificiale al mondo".

I deepfake sono una delle minacce emergenti più gravi rischi.

Questa valutazione è supportata da uno studio condotto dall'University College London (UCL), dove 31 esperti hanno classificato le minacce più significative poste dal crimine guidato dall'intelligenza artificiale. La ricerca, finanziata dal Dawes Centre for Future Crime dell'UCL, ha evidenziato i deepfake come uno dei rischi emergenti più gravi. Tra i 20 usi nefasti dell'intelligenza artificiale identificati, i deepfake si sono distinti per il loro potenziale di causare danni diffusi nei prossimi 15 anni.

L'accessibilità della tecnologia di rilevamento dei deepfake e i suoi rischi

La proliferazione di strumenti di creazione di deepfake open source ha reso questa tecnologia accessibile a un pubblico più vasto. Anche individui con competenze tecniche minime possono ora produrre deepfake utilizzando software come Laboratorio DeepFace, un sistema che alimenta 95% di creazioni deepfake. Questa accessibilità significa che le minacce deepfake non sono più limitate a sviluppatori altamente qualificati o organizzazioni criminali informatiche ben finanziate, ma sono ora una minaccia informatica diffusa che può emergere da praticamente chiunque abbia un computer e una connessione Internet.

Gartner ha commentato i rischi che i deepfake presentano per le aziende a livello globale, affermando: "Nell'ultimo decennio, si sono verificati diversi punti di svolta nei campi dell'intelligenza artificiale che consentono la creazione di immagini sintetiche. Queste immagini generate artificialmente di volti di persone reali, note come deepfake, possono essere utilizzate da attori malintenzionati per minare l'autenticazione biometrica o renderla inefficiente", ha affermato Akifi Khan, VP Analyst presso Gartner. "Di conseguenza, le organizzazioni potrebbero iniziare a mettere in discussione l'affidabilità delle soluzioni di verifica e autenticazione dell'identità, poiché non saranno in grado di dire se il volto della persona che viene verificata è una persona in carne e ossa o un deepfake".

Diffusione virale dei deepfake: il ruolo dei social media

Una volta creati, i deepfake possono diffondersi rapidamente su varie piattaforme di social media, sfruttando narrazioni emotivamente cariche o controverse per ottenere trazione. Questa viralità esacerba la sfida di mitigarne l'impatto, poiché possono influenzare la percezione pubblica prima del rilevamento.

Frode finanziaria e schemi abilitati da deepfake

I deepfake vengono sempre più utilizzati come armi, creando rischi significativi per le aziende. I truffatori hanno utilizzato audio e video deepfake per impersonare dirigenti, ingannando i dipendenti affinché trasferissero fondi o divulgassero informazioni sensibili.

Un caso degno di nota è avvenuto a Hong Kong, dove un impiegato finanziario di una multinazionale è stato ingannato e indotto a trasferire $25 milioni. Secondo la polizia di Hong Kong, gli aggressori hanno utilizzato la tecnologia deepfake per impersonare in modo convincente il CEO dell'azienda durante una videoconferenza.

I media manipolati possono danneggiare gravemente l'immagine del marchio di un'azienda. Un video deepfake che ritrae un CEO in una situazione compromettente, ad esempio, potrebbe causare una reazione negativa da parte dell'opinione pubblica e minare la fiducia tra gli stakeholder.

Sfide e direzioni future nella lotta ai deepfake

Sfortunatamente, molti algoritmi di rilevamento scadenti affrontano sfide come alti tassi di falsi positivi e la sofisticatezza in evoluzione delle tecnologie di creazione di deepfake. Aggiornamenti continui e collaborazione tra aziende e sviluppatori tecnologici sono essenziali per rimanere al passo con queste minacce.

Per rilevare i deepfake in tempo reale, acquisendo e analizzando un'ampia e set di dati imparziale è necessario.

Come osservato nello studio 'Deepfake Video Detection: Challenges and Opportunities' (Kaur e altri, 2024),“Nonostante i notevoli progressi negli algoritmi di rilevamento e video deepfake, restano irrisolte diverse sfide cruciali per gli attuali metodi di rilevamento video deepfake. Per rilevare i deepfake in tempo reale, è necessario acquisire e analizzare un set di dati ampio e imparziale. La raccolta di dati in tempo reale è una delle principali limitazioni del metodo basato sul Deep Learning (DL). Sfortunatamente, molte aree di applicazione in tempo reale non possono accedere a grandi quantità di nuovi dati.”

Ciò evidenzia un problema chiave con la maggior parte dei sistemi di rilevamento deepfake: gli strumenti sono efficaci solo quanto i set di dati su cui vengono addestrati. Senza accesso a dati diversificati e aggiornati, anche i modelli di rilevamento AI avanzati hanno difficoltà a tenere il passo con deepfake sempre più sofisticati. Le aziende non devono solo investire in tecnologie di rilevamento deepfake affidabili, ma anche supportare migliori pratiche di condivisione dei dati e collaborazione tra i settori per colmare questa lacuna.

Strumenti di rilevamento Deepfake per salvaguardare la fiducia digitale

Per affrontare la sfida della manipolazione dei deepfake, le aziende devono adottare strumenti e software avanzati per il rilevamento dei deepfake. Questi sistemi si basano su una combinazione di tecniche di deep learning e algoritmi di machine learning per analizzare meticolosamente i media digitali (inclusi immagini, video e audio) alla ricerca di segni di contenuti generati o manipolati.

95% di tutti i processi standard di onboarding dei clienti non riescono a rilevare la presenza di falsi documenti d'identità.

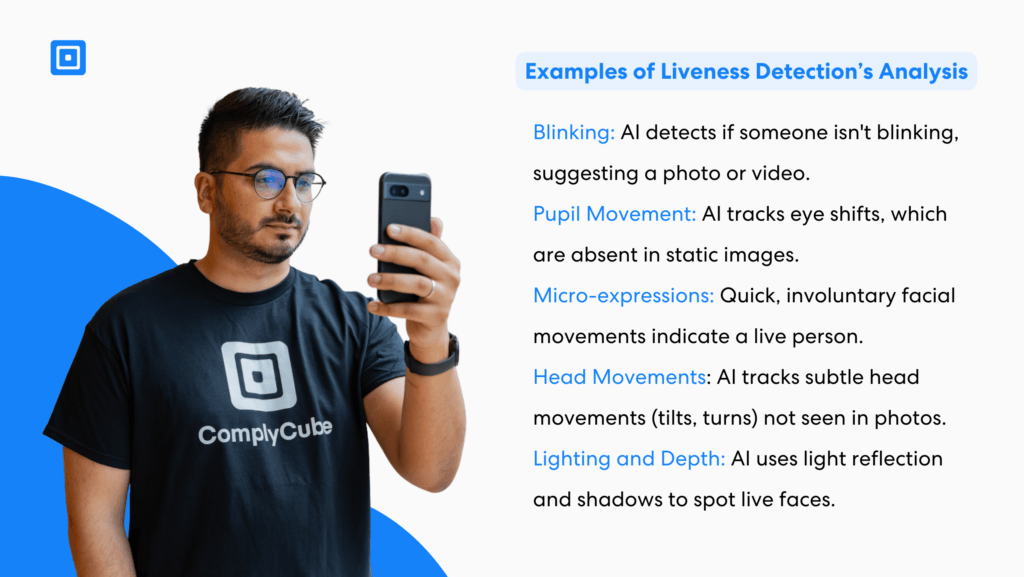

Una piattaforma innovativa di rilevamento deepfake in questo spazio è ComplyCube. La piattaforma tecnologia di rilevamento della vitalità stabilisce un nuovo punto di riferimento nella verifica biometrica, verificando che i dati biometrici provengano da una persona reale e vivente, anziché da immagini statiche, video preregistrati o deepfake generati dall'intelligenza artificiale.

Basato su algoritmi avanzati di intelligenza artificiale e apprendimento automatico, analizza microespressioni, texture della pelle, modelli di riconoscimento facciale e interazioni ambientali in tempo reale. Attraverso un approccio multimodale, che combina controlli attivi, come movimenti guidati della testa, con analisi passive che operano silenziosamente in background, ComplyCube rileva senza problemi sofisticati tentativi di spoofing, tra cui foto stampate, maschere 3D e riproduzioni video. Questo sistema robusto offre una verifica dell'identità altamente accurata, sicura e senza attriti, consentendo alle aziende di prevenire con sicurezza le frodi.

Rafforzare la resilienza contro le minacce Deepfake con gli strumenti di rilevamento Deepfake

I deepfake rappresentano una sfida formidabile alla fiducia digitale, in particolare per le aziende che si sforzano di mantenere operazioni sicure e affidabili. Adottando strumenti avanzati di rilevamento dei deepfake e integrandoli in framework di sicurezza informatica completi, le organizzazioni possono mitigare i rischi posti dai media manipolati.

ComplyCube è una potente piattaforma progettata per affrontare la crescente sfida del rilevamento dei deepfake sfruttando tecniche avanzate di apprendimento automatico e tecnologie di apprendimento profondo. Combinando il riconoscimento facciale, l'analisi dei documenti e le misure anti-spoofing, la piattaforma garantisce una verifica dell'identità sicura e affidabile, anche in un'epoca in cui il rilevamento dei video deepfake sta diventando sempre più difficile.

Riconoscimento facciale robusto e analisi di similarità: ComplyCube utilizza il rilevamento della vitalità biometrica certificato ISO 30107-3 e PAD Livello 2 per garantire un riconoscimento facciale accurato. Confrontando video reali e campioni di dati biometrici, lo strumento distingue efficacemente gli utenti autentici dalle identità manipolate. Le sue capacità di rilevamento deepfake sono migliorate analizzando i tratti del viso, i modelli comportamentali e altri segnali biologici univoci, creando un ulteriore livello di garanzia di verifica.

Verifica avanzata dei documenti: Utilizzando una combinazione di tecniche avanzate di apprendimento automatico e competenze umane, ComplyCube analizza un'ampia gamma di documenti di identità, come passaporti, patenti di guida, carte d'identità nazionali, permessi di soggiorno e timbri di visto. Questo processo di verifica prevede il controllo incrociato dei documenti con set di dati attendibili per identificare segni di manomissione, contraffazione o blacklist, assicurando che siano autentici e inalterati.

Tecnologia di rilevamento della vitalità all'avanguardia: Con il rilevamento della liveness PAD-Level 2 basato sull'intelligenza artificiale, ComplyCube può rilevare i video deepfake e prevenire i tentativi di impersonificazione. Questo sistema utilizza algoritmi anti-spoofing per identificare discrepanze sottili tra video reali e media manipolati, proteggendo dalle sfide sempre più sofisticate del rilevamento deepfake.

Onboarding biometrico senza soluzione di continuità: ComplyCube offre un'esperienza di acquisizione guidata del volto, semplificando il processo di onboarding biometrico per settori quali finanza, telecomunicazioni, viaggi e servizi aziendali. Concentrandosi sull'integrazione di set di dati di alta qualità e sull'ottimizzazione continua del sistema, lo strumento fornisce un processo di autenticazione fluido e accurato.

Di fronte alle crescenti minacce dei contenuti falsi generati dall'intelligenza artificiale, un partner come ComplyCube svolge un ruolo essenziale nel rafforzare la fiducia digitale. Il suo approccio completo al riconoscimento facciale, alla verifica dei documenti e al rilevamento dei deepfake aiuta le organizzazioni a rimanere al passo con le sfide, garantendo al contempo l'integrità dei loro processi di verifica dell'identità.

Contatta uno dei ComplyCube esperti di conformità oggi per maggiori informazioni su come proteggere la tua organizzazione.