La tecnologia AI si è evoluta rapidamente da una novità a una minaccia per i processi socioeconomici, politici e democratici in tutto il mondo tramite frodi deepfake. Il software di rilevamento deepfake, comprese le soluzioni di verifica dell'identità (IDV) come la verifica dei documenti e la verifica biometrica, deve essere adottato rapidamente per garantire che le economie, i governi e la nostra vita quotidiana possano continuare senza interruzioni.

L'impatto dei deepfake sulle elezioni, sulla fiducia del pubblico e sull'autenticità aziendale è una preoccupazione crescente. Mentre ci avviciniamo a cicli elettorali critici in diverse democrazie, comprendere i pericoli posti da questa tecnologia è più importante che mai. Questa guida esamina più in dettaglio come queste minacce si stanno concretizzando e le best practice per impedire che infestino il mondo digitale.

Cos'è un Deepfake?

I deepfake prendono il nome da una metodologia di intelligenza artificiale (IA), il deep learning. Un algoritmo di deep learning è in grado di imparare da solo come risolvere problemi estremamente complessi analizzando vasti set di dati. Questi algoritmi possono scambiare volti in immagini, video, suoni e qualsiasi altra forma di contenuto digitale per creare contenuti iperrealistici ma falsi.

Il mondo si sta rapidamente dirigendo verso una crisi deepfake, con grandi timori su come questa tecnologia AI avrà un impatto e sta già avendo un impatto sull'ambiente socioeconomico e politico globale. Più di recente, i timori sull'integrità dei risultati elettorali sono stati messi sotto esame.

Che cos'è il rilevamento Deepfake?

Il rilevamento di deepfake è il processo utilizzato per identificare immagini, suoni o video creati artificialmente per apparire iperrealistici. In genere, l'intelligenza artificiale generativa viene utilizzata nei processi di verifica dei documenti e di verifica biometrica per rilevare modelli nei contenuti deepfake che non esisterebbero nei "contenuti reali".

Le soluzioni IDV basate sull'intelligenza artificiale stanno rapidamente diventando l'unico modo per contrastare in modo affidabile la tecnologia deepfake e mitigare questo tipo di frode di identità. In modo comparabile a un essere umano, queste tecnologie possono identificare contenuti falsificati in modo molto più efficace, essendo in grado di elaborare molti più dati in un dato periodo di tempo, in modo molto più accurato e in modo molto più conveniente.

Nel settembre 2023, tre importanti agenzie delle forze dell'ordine, la National Security Agency (NSA), il Federal Bureau of Investigation (FBI) e la Cybersecurity and Infrastructure Security Agency (CISA), hanno pubblicato un documento in cui dichiaravano che le minacce deepfake erano aumentate in modo esponenziale e che erano essenziali tecnologie automatizzate e preventive.

Minacce provenienti dai media sintetici, come i deepfake sono aumentati esponenzialmente.

La crescente minaccia dei deepfake in tutto il mondo e tra i settori richiede una maggiore necessità di soluzioni di verifica dell'identità robuste. Tali soluzioni richiedono un'intelligenza artificiale generativa (Gen AI) simile per alimentare misure preventive in grado di contrastare le minacce fraudolente.

Verifica del documento

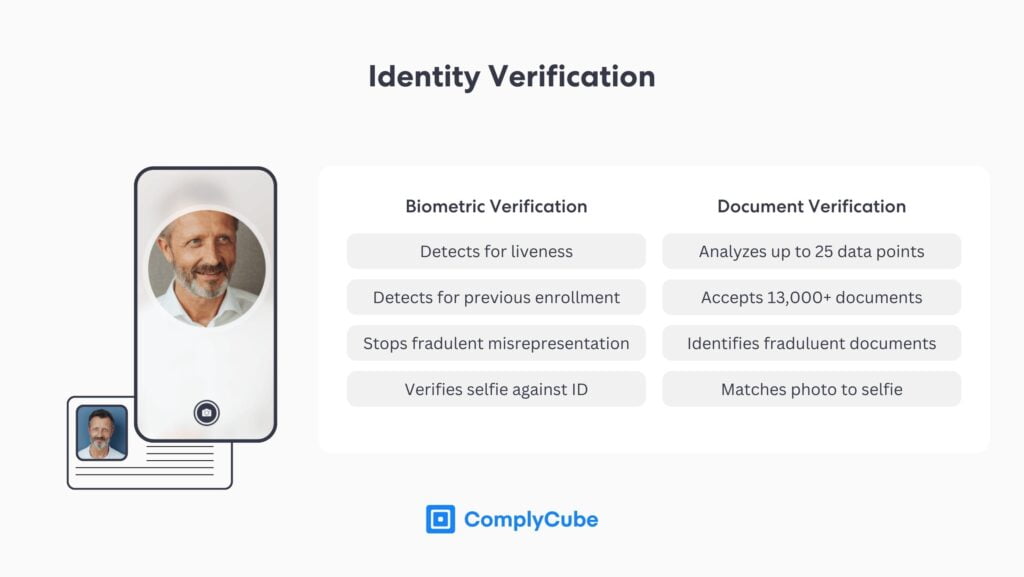

Verifica del documento è uno dei due passaggi chiave nei processi Anti-Money Laundering (AML), Know Your Customer (KYC) e IDV. Questo processo utilizza un motore di verifica basato sull'intelligenza artificiale per leggere i documenti KYC, come la patente di guida, in meno di 15 secondi.

Verificando simultaneamente l'autenticità del documento ed estraendo i dati disponibili, la verifica del documento fornisce un forte livello di garanzia dell'identità. Agisce anche come un robusto sistema di rilevamento preliminare di deepfake, essendo in grado di identificare immagini create artificialmente di carte d'identità. Per maggiori informazioni su Gen AI e metodi di rilevamento di deepfake, leggi Frodi generate dall'intelligenza artificiale e verifica dell'identità.

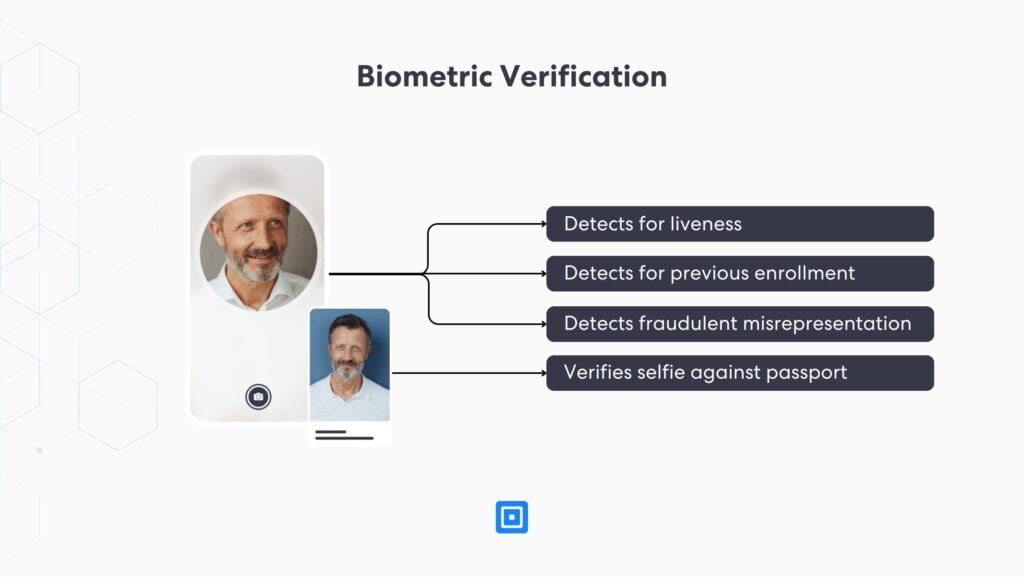

Verifica biometrica

Verifica biometrica utilizza potenti tecnologie di identificazione biometrica e riconoscimento facciale per scansionare, verificare e autenticare i dati biometrici degli utenti. Analizzando le informazioni biometriche, come i tratti del viso, le microespressioni, i toni della pelle e la consistenza (a volte utilizzando dati alternativi come le scansioni dell'iride), questo processo funge da strumento di rilevamento della vitalità e previene gli attacchi di presentazione, come i deepfake.

L'autenticazione e la verifica biometrica sono i metodi più sicuri per verificare l'identità di una persona e sono essenziali per rilevare i deepfake. I dati biometrici sono i più difficili da falsificare, anche con l'intelligenza artificiale; tuttavia, ciò non significa che i deepfake siano facili da rilevare.

Le soluzioni IDV automatizzate sono una componente critica nei moderni processi di verifica dell'identità, acquisizione clienti e autenticazione, a causa dell'enorme volume di controlli che devono essere completati in modo accurato e su larga scala. Per maggiori informazioni, leggi I vantaggi della verifica biometrica.

Deepfake e integrità elettorale

I deepfake hanno il potenziale di minare le elezioni diffondendo false informazioni e manipolando l'opinione pubblica. Nel Regno Unito, uno studio recente dell'Alan Turing Institute ha scoperto che quasi nove persone su dieci sono preoccupate che i deepfake possano influenzare i risultati delle elezioni (The Alan Turing Institute).

9 su 10 preoccupati per i deepfake che influenzano i risultati delle elezioni.

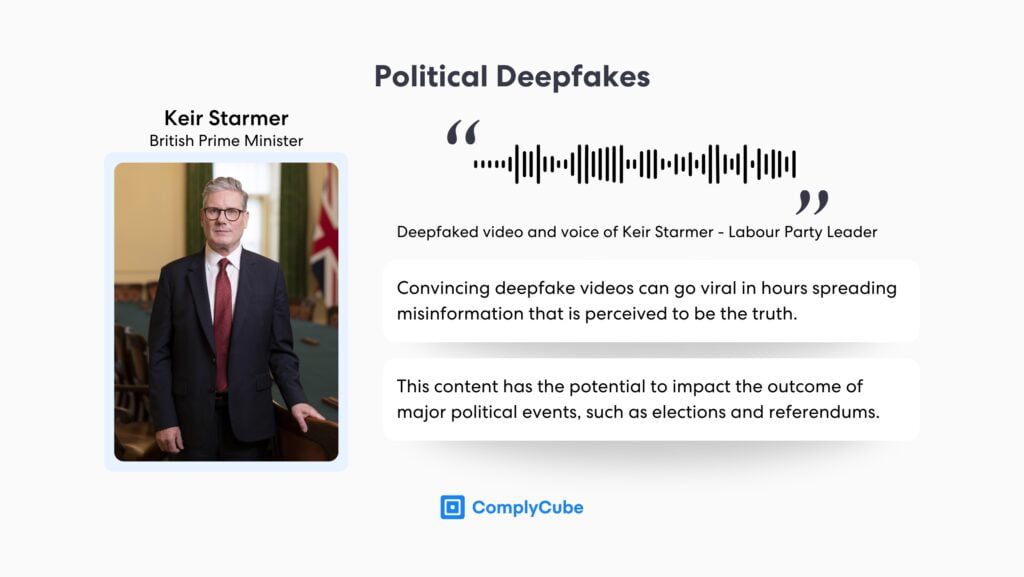

Questa preoccupazione non è infondata. Sono già emersi casi di deepfake di alto profilo che prendono di mira personaggi politici, come clip audio e video fabbricate di leader di spicco, con il potenziale di seminare discordia e confusione tra gli elettori.

Ad esempio, in vista delle elezioni generali del Regno Unito del 2024, sui social media sono stati diffusi dei deepfake che imitavano le voci dell'allora primo ministro Rishi Sunak, del leader laburista Keir Starmer e del sindaco di Londra Sadiq Khan, raggiungendo centinaia di migliaia di spettatori e creando idee sbagliate.

Queste manipolazioni spaziavano da falsi scandali di corruzione a dichiarazioni fuorvianti su posizioni e intenzioni politiche. Tali contenuti possono essere incredibilmente dannosi, soprattutto quando gli elettori non riescono a distinguere tra vero e falso.

Rilevamento e risposta ai deepfake

Rilevare i deepfake è sempre più difficile, persino per giganti della tecnologia come Meta, Google e Microsoft, che si sono impegnati a contrastare l'intelligenza artificiale ingannevole nelle elezioni. Il problema principale risiede nella sofisticatezza degli strumenti di intelligenza artificiale che possono creare contenuti indistinguibili dalla realtà.

Ad esempio, il presidente degli affari globali di Meta, Nick Clegg, ha sottolineato le sfide nell'identificazione dei contenuti generati dall'intelligenza artificiale, sottolineando che gli attori malintenzionati possono rimuovere i marcatori invisibili che solitamente indicano manipolazione.

La minaccia dei deepfake è globale e sembra seguire gli eventi internazionali. In America, i deepfake che imitano La voce del presidente Joe Biden è stata utilizzata in una chiamata automatica per condividere false informazioni sulle elezioni. Questo incidente mette in luce il potenziale dei deepfake nel limitare l'affluenza alle urne diffondendo informazioni fuorvianti.

Inoltre, il problema si estende oltre la semplice identificazione dei deepfake. La rapida diffusione di contenuti fraudolenti implica che una volta che un deepfake diventa virale, è probabile che il danno sia stato fatto prima che l'immagine o il video vengano smentiti.

Ciò richiede un'azione sui contenuti fraudolenti prima che possano essere caricati. Le piattaforme di social media come Twitter (ora X), Facebook, Instagram e molte altre devono impiegare solide difese basate sull'intelligenza artificiale per riconoscere i media fraudolenti prima che possano essere pubblicati. Tale azione potrebbe essere eseguita tramite potenti SDK e API di rilevamento della vitalità. Per maggiori informazioni, leggi Integrazione con un SDK di rilevamento della vivacità.

Rilevamento Deepfake nella verifica dell'identità

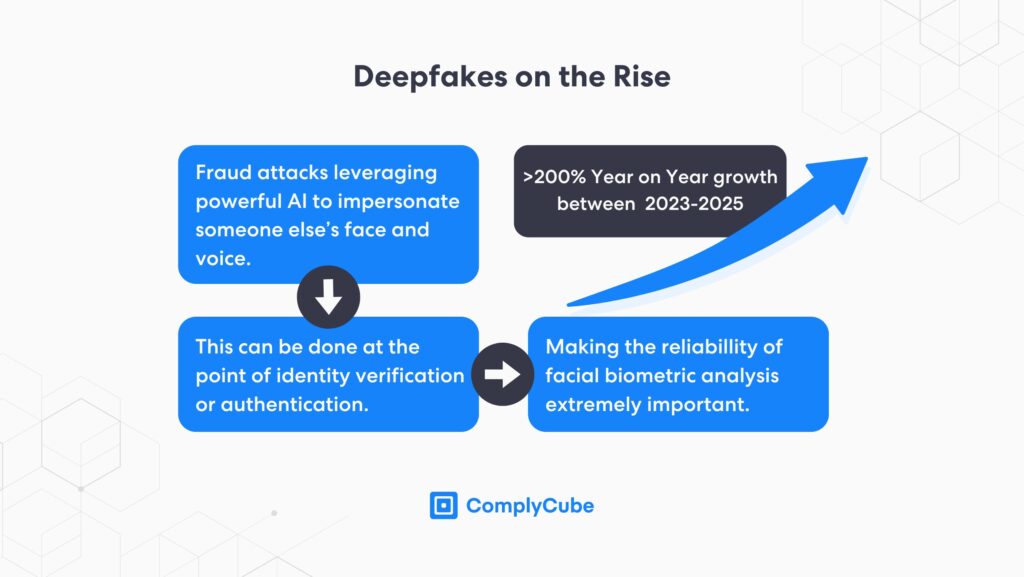

I deepfake si sono infiltrati in molti più settori dei social media. Sono diventati un problema di primo piano nei metodi di verifica e autenticazione dell'identità per molteplici settori finanziari, tra cui applicazioni bancarie tradizionali, app di trading e criptovalute e servizi di pagamento. Gli attacchi deepfake vengono utilizzati ogni giorno per commettere frodi, prosciugare i conti e persino aprire nuovi conti, come con società di credito.

L’intelligenza artificiale generativa rappresenta la minaccia più grande per il settore [finanziario], consentendo potenzialmente che le perdite dovute a frodi raggiungano $40bn negli Stati Uniti entro il 2027, in aumento rispetto a $12,3 miliardi nel 2023.

Questa previsione suggerisce quindi che le frodi deepfake potrebbero aumentare di oltre 200% in un periodo di 4 anni, diventando una delle principali cause di frode finanziaria a livello globale.

L’erosione della fiducia con la tecnologia fraudolenta

Oltre alle elezioni, la proliferazione dei deepfake rappresenta una minaccia più ampia alla fiducia pubblica e privata nelle informazioni e nell'identità. Man mano che la tecnologia deepfake diventa più diffusa, le persone stanno diventando sempre più scettiche nei confronti dei media che consumano. Questo scetticismo nei media potrebbe portare a un fenomeno noto come dividendo del bugiardo, dove la possibilità di contenuti falsi offre agli individui una plausibile possibilità di negazione, minando la responsabilità e la verità.

Un esempio comune di questo fenomeno è la copertura mediatica dannosa di una figura pubblica, un leader politico o un leader aziendale. Lo scetticismo nei media autentici consente a questi individui di giocare su questo sentimento pubblico, usandolo a proprio vantaggio per affermare che non è autentico. È facile vedere come questo effetto potrebbe ingigantirsi.

Creare fiducia su larga scala con il software di rilevamento Deepfake

Sebbene i pericoli dei deepfake siano chiari, risposte normative efficaci sono ancora in fase di sviluppo. Mentre negli Stati Uniti manca un'azione normativa a livello nazionale, almeno 20 stati hanno emanato leggi contro i deepfake elettorali, ma una strategia federale coesa resta sfuggente. Il Dipartimento del Tesoro, tuttavia, si è impegnato ad approvare le tecnologie automatizzate come le migliori misure per prevenire e contrastare le metodologie fraudolente emergenti.

Anche il Regno Unito ha registrato progressi limitati. Sebbene esistano leggi contro la creazione e la distribuzione di contenuti deepfake personali dannosi, come i deepfake espliciti, devono ancora essere emanate normative più ampie che affrontino la creazione e l'uso di deepfake per la manipolazione elettorale.

Per ora, spetta all'azienda in questione adottare soluzioni IDV robuste per contrastare il movimento fraudolento deepfake. Le aziende devono includere la possibilità di frode deepfake nel loro approccio basato sul rischio (RBA) quando prendono in considerazione una strategia AML adatta.

Informazioni su ComplyCube

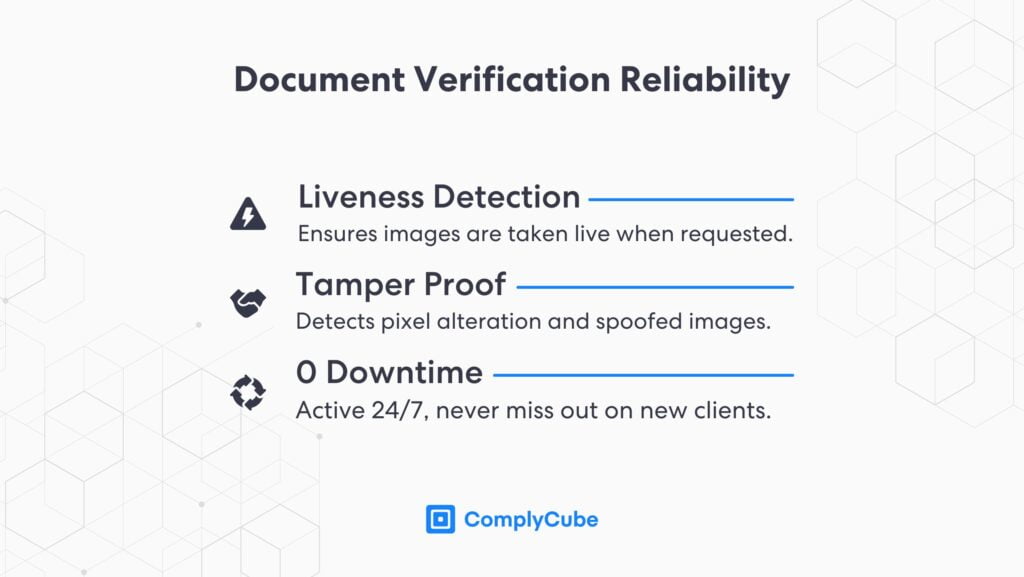

Per combattere la crescente minaccia delle frodi AI, la tecnologia di rilevamento deepfake e le soluzioni IDV sono ora essenziali. Queste tecnologie utilizzano Gen AI per analizzare set di dati simili utilizzati per creare deepfake per identificare contenuti falsi e mitigare le frodi.

La verifica dei documenti e la verifica biometrica di ComplyCube sono due metodi chiave utilizzati nell'IDV per verificare e autenticare le identità rilevando i contenuti deepfake e sono impiegati da centinaia di aziende tecnologiche in tutto il mondo.

Il principale fornitore di soluzioni IDV è stato creato per combattere le crescenti minacce di metodologie fraudolente innovative nel 21° secolo. Sfruttando algoritmi avanzati di intelligenza artificiale e apprendimento automatico, la piattaforma di ComplyCube offre servizi completi di verifica IDV e biometrica, garantendo una solida protezione contro le frodi di identità e i contenuti deepfake.

Grazie a una soluzione flessibile e personalizzabile, i loro servizi possono essere personalizzati in base alla RBA di un'azienda per aiutare le aziende a migliorare i loro protocolli di sicurezza, mantenere la conformità con gli standard normativi e creare fiducia con i loro clienti in un mondo sempre più digitale. Per maggiori informazioni, contatta oggi stesso uno specialista della conformità.